GLI ARTICOLI DI PIERO PISTOIA SONO IN CORSO DI MODIFICA PER AGGIORNAMENTO

CURRICULUM di piero pistoia

piero-pistoia-curriculumok (#)

Links interni agli articoli

1-Marcello Buiatti_L’EVOLUZIONE RIVISITATA

2-Piero Pistoia_EVOLUZIONE, ISTINTO E RAGIONE

3-Piero Pistoia_EVOLUZIONE: UN IPOTETICO SCHEMA EVOLUTIVO

3_1- Riassunto

3_2 Precisazioni introduttive

3_3 – Ipotesi ‘tentative‘ (TT di Popper) sui possibili progenitori della linea delle grandi scimmie e quella degli ominini (cenni)

3_4 – Brevi considerazioni sulla teoria degli Equilibri Punteggiati

3_5 – L’albero dell’evoluzione umana; schema in continuo aggiornamento

3_6 – Sulla prima e seconda ‘esplosione’ di specie degli ominini

3_7 – Una specie-chiave dell’evoluzione umana ed altro.

4-NOTE-FOTOSINTESI CLOROFILLIANA a cura di Piero Pistoia

——————————————————————————-

1-Marcello Buiatti_EVOLUZIONE RIVISITATA

L’EVOLUZIONE RIVISITATA

Dott. Prof. Marcello Buiatti, professore ordinario di genetica, Università di Firenze.

L a storia delle Scienze Biologiche è relativamente recente rispetto a quella di altre discipline scientifiche come, ad esempio, la fisica, la chimica ed ancora di più la matematica. Molti contestano la stessa esistenza di vere teorie biologiche dato il livello non elevato di matematizzazione e comunque di capacità predittiva che queste sembrano avere. Non vi è dubbio comunque che, se di vere teorie si può parlare in biologia, queste sono quelle evolutive, a cominciare dalla prima enunciazione compiuta del concetto di storia dei cambiamenti nella vita, quella di Lamark, per andare al nucleo teorico centrale delle teorie evolutive, ancora oggi in gran parte valido, quello di Darwin. La versione del darwinismo, sviluppata fra le due guerre e articolatasi nel secondo dopoguerra, prevede che gli esseri viventi cambino essenzialmente per l’effetto dei tre processi fondamentali, la mutazione, la selezione, la deriva genetica, che modificano la struttura dei patrimoni ereditari delle popolazioni. Il tutto parte da alcune constatazioni abbastanza banali. Ogni carattere controllato quasi interamente dai geni, come ad esempio, il colore degli occhi, è presente nelle popolazioni in due o più forme alternative (nero, azzurro, ecc.). Se consideriamo quindi un carattere alla volta potremo dire che in una popolazione è presente una certa percentuale di geni che determinano il colore azzurro, ed un’altra di determinanti ereditari che danno occhi neri. Queste forme alternative sarebbero il risultato della diversificazione avvenuta per modificazione della stessa porzione di materiale ereditario durante la storia della specie. E’ la capacità di modificarsi (di “mutare”) che ha portato alla variabilità genetica senza la quale le popolazioni non potrebbero cambiare ed evolversi. Come procederebbe allora l’evoluzione? Poniamo, ad esempio, da una popolazione fatta di individui che hanno tutti gli occhi neri in cui compare una mutazione dal nero all’ azzurro. La presenza di questa mutazione potrà portare nel tempo al cambiamento del colore degli occhi nella popolazione , se interverranno due processi. La selezione, che per i darwinisti classici è il processo più importante, agisce quando una delle forme alternative è più vantaggiosa dell’altra per la sopravvivenza e quindi permette che gli individui che la posseggono si riproducano più degli altri. E’ ovvio allora che, ad ogni generazione, se ad esempio gli individui con gli occhi azzurri per qualche ragione si riproducono di più che quelli con gli occhi neri, si avrà un aumento percentuale dei primi fino a determinare , dopo numerose generazioni, la scomparsa dei secondi. La deriva genetica è invece un processo casuale. Poniamo per capirsi, si parta da una popolazione con il 20% di occhi azzurri e l’80% di occhi neri e che la popolazione consista di molti milioni di individui. Mettiamo poi che un piccolo drappello (ad esempio, una ventina di individui), si allontanino dalla popolazione originaria e fondi una nuova colonia. Sarà in questo caso molto difficile che il piccolo campione degli “esploratori” sia esattamente composto da 16 individui con gli occhi neri e quattro con gli occhi azzurri, rispecchiando così fedelmente la composizione iniziale, mentre sarà molto più facile una fluttuazione che sarà tanto più grande tanto più piccolo e poco rappresentativo sarà il campione. Quali sono i concetti base che emergono da questa impostazione? Innanzitutto che l’evoluzione procede a partire dalle mutazioni dei singoli geni che offrono il terreno su cui agiscono selezione e deriva genetica. La prima, secondo i darwinisti, sarebbe essenzialmente determinata dall’ambiente da cui verrebbero le indicazioni sulle forme di ogni carattere da avvantaggiare e su quelle a cui attribuire uno svantaggio riproduttivo ad ogni generazione, mentre la seconda sarebbe determinata dal sorteggio casuale delle diverse forme (alleli). Ne deriva che: a) la selezione agisce indipendentemente su ogni gene; b) i cambiamenti, di generazione in generazione, sono quantitativi e lenti in quanto cambiano le percentuali delle diverse forme ma non ci sono “salti” che modifichino improvvisamente tutta la popolazione; c) gli individui sono interamente determinati dai geni per cui ad un corredo genetico (insieme di geni) corrisponde una ed una solo forma di vita (il “fenotipo”) su cui in modo diretto agiscono i processi che abbiamo appena discusso. Fin qui, naturalmente in modo molto schematico, il neodarwinismo, prima dei nuovi dati che si sono rapidamente accumulati da quando sono stati scoperti metodi raffinati di analisi del materiale genetico (il DNA) e di tutta la macchina molecolare degli organismi. Dagli studi più recenti sono emerse, in estrema sintesi dato il poco spazio a disposizione, le seguenti considerazioni rilevanti per l’evoluzione: 1) – I geni hanno un certo livello di ambiguità nel senso che, soprattutto negli organismi “superiori” (animali e piante) uno stesso gene può essere “letto” in modo diverso, ad esempio, in tessuti diversi dello stesso organismo. 2) – Pochi geni sono attivi nello stesso momento di vita di una cellula. Ad esempio, si calcola che dei 120000 geni presenti nel patrimonio ereditario di ogni essere umano solo circa 2000 vengono contemporaneamente utilizzati in una singola cellula, E infatti le cellule che si compongono sono molto diverse l’una dall’altra, il che permette la specializzazione delle funzioni, proprio perché essenzialmente a funzioni diverse corrispondono diverse combinazioni di geni. Molto del nostro fenotipo dipende quindi da quali geni sono attivati e dove (in quali cellule) e questo a sua volta dipende dai segnali che le cellule si scambiano fra loro e da quelli che ricevono dall’ambiente con processi di regolazione raffinata che ci permettono di rispondere alle variazioni ambientali, percependole e traducendole in attivazione ed inattivazione di gruppi di geni diversi. 3) – In molti casi, per il risultato in termini di fenotipo, è importante non tanto o soltanto quale forma di un determinato gene è presente, ma quanto è attiva, se naturalmente lo è. Per fare un esempio banale, se ci sono, come ci sono, dei geni che con la loro azione fanno allargare una mano ed altri che la fanno allungare è ovvio che nessuno può avere una mano che si allunga soltanto o si allarga soltanto, ma tutti invece avranno mani durante lo sviluppo delle quali si sono attivati più o meno i due gruppi di geni portando alla fine ad una forma che è contemporaneamente “un po’ lunga ed un po’ larga”. 4 )– I geni e gli strumenti che ne derivano (le proteine) interagiscono fra loro in modo complesso. E’ ovvio a tutti per esempio che un individuo che ha i geni adatti per assumere ed assimilare molto cibo dovrà avere anche altri geni che gli permettano di eliminare efficacemente quanto meno gli scarti, pena grandi difficoltà metaboliche durante la vita. Ciò significa che una mutazione di un gene che aumenti la capacità di assimilazione dell’individuo portatore avrà un effetto positivi se gli altri geni (quelli per l’eliminazione delle scorie) saranno nelle forme più attive, negativo nel caso contrario. Ne discende che la capacità di riprodursi non deriverà dalla somma delle azioni geniche, ma dalla combinazione, nel senso che ogni gene dovrà essere adatto a convivere in armonia con gli altri geni perché poi l’organismo sia in grado di sopravvivere e riprodursi nell’ambiente in cui si trova. Da questo deriva allora che non tutte le mutazioni sono compatibili con la sopravvivenza, ma che lo sono soltanto se si trovano nel giusto contesto di geni. 5)– Alcuni geni sono più importanti di altri. Un gene che abbia informazioni per la sintesi di sostanze ad azione ormonale avrà per esempio effetto sul funzionamento di molti altri geni e quindi influenzerà di più la capacità di sopravvivenza di quanto non faccia il gene per il colore degli occhi di cui si parlava prima, la cui azione è limitata a quel carattere. Se questo è vero, significa che una mutazione di un gene importante potrà o portare alla morte oppure ad una sopravvivenza bassa fino a quando anche gli altri geni ad esso collegati non si saranno adeguatamente modificati in funzione della nuova situazione. In altri termini allora, una singola mutazione porterà ad un effetto a cascata il cui risultato finale sarà un cambiamento drastico (un “salto” evolutivo). Tutto questo, come si accennava prima, non è in contraddizione con il darwinismo ma ne modifica alcune caratteristiche soprattutto perché introduce il concetto che il fenotipo non è predicibile in modo rigido a partire solo dalla natura qualitativa dei singoli geni, ma deriva dal contesto interno (l’insieme dei geni) dai processi di attivazione-inattivazione, dai segnali che vengono dall’esterno, il tutto in continuo cambiamento per il cambiare dell’ambiente, per le mutazioni, ecc.. L’adattibilità di un individuo e quindi il vantaggio e lo svantaggio selettivo non sono caratteristiche stabili e predeterminate, ma hanno una storia che è poi la storia di vita dell’organismo stesso. La selezione allora agisce in funzione dell’ambiente, ma anche delle caratteristiche proprie, anch’esse variabili, della organizzazione interna (la auto-organizzazione). Tutto ciò porta ad una evoluzione con strategie molto diversificate di adattabilità che procede per periodi di cambiamento lento neodarwiniano classico e per improvvise accelerazioni che derivano da mutazioni importanti all’interno e da cambiamenti drastici all’esterno in una dialettica che era stata in parte prevista da Lamark, ma anche Darwin stesso quando aveva enunciato la cosiddetta legge della correlazione fra le parti nell’ evoluzione, secondo la quale nessuna parte può cambiare senza tener conto del contesto formato dalle altre. E questo, a ben vedere, è valido per la singola cellula, in cui le diverse attività metaboliche devono essere armoniche, per l’organismo, in cui le cellule devono tener conto le une delle altre, per le popolazioni, gli ecosistemi, la biosfera, tutte entità che si auto-organizzano, mutano, si adattano ai cambiamenti dell’ambiente esterno di questo nostro Pianeta.

Dott. Prof. Marcello Buiatti

(Dipartimento di Biologia animale e Genetica Università degli studi di Firenze)

———————————————————

2-Piero Pistoia_EVOLUZIONE, ISTINTO e RAGIONE

EVOLUZIONE, ISTINTO E RAGIONE: ASPETTI EDUCATIVI E PENSIERI DIVERGENTI del dott. Piero Pistoia

INTRODUZIONE

Il genere Homo e’ caratterizzato dalla possibilità di accumulare Cultura attraverso la fuga delle generazioni. Oggi, in questa fase detta “Post-Industriale di Transizione” (1), il Mondo Culturale si organizza in strutture così complesse e articolate da far pensare che possa essere dotato di vita autonoma, orientando e dirigendo la propria espansione (Terzo Mondo di Popper) (2). L’uomo e’ trascinato da questo vortice culturale verso un isolamento sempre piu’ profondo in un complesso universo di simboli e le previsioni per il futuro (Società dei Servizi) (1) lo vedono chiuso in una individualità egocentrica e narcisistica (3) e costretto in un isolato e freddo rapporto interattivo uomo-macchina (già oggi si parla sempre meno di Mass Media e sempre più di Personal Media). Si capisce cosi’ come siano potuti sorgere in maniera drammatica e improvvisa i problemi delle reciproche relazioni e del rapporto con l’ambiente esterno, urgenti oggi, insolubili domani, che coinvolgono la stessa sopravvivenza dell’uomo come specie sul pianeta. La soluzione di questi problemi, chiamati da A. Visalberghi “ipercomplessi”, non rimanda solo ad una complessità naturalistica di tipo scientifico, ma anche ad una complessità della preferibilità, sulla quale influisce fortemente il senso morale e il patrimonio dei valori dell’uomo che sempre presiedono a giudizi e valutazioni e quindi alle scelte (4). Sono dell’avviso che questo senso profondo del rispetto dell’uomo e dell’ambiente, che dovrà operare scelte sul modo di indirizzare la ricerca scientifica e la programmazione economica volte alla soluzione dei problemi planetari, può essere ritrovato e partecipato consapevolmente in una riflessione sulla storia umana delle nostre lontane origini, in specie da parte dei giovani chiamati presto direttamente in causa. Per riscoprire l’identità umana nell’uomo di oggi e’ necessario tornare a controllare com’era l’Uomo di milioni di anni fa. Questa ricerca nel nostro lontano passato e’ ricca di suggerimenti educativi, di direttrici di comportamento, di ammonimenti e consigli.

EREDITA’ BIOLOGICA UMANA E RIFLESSI SOCIALI

In generale possiamo affermare che tutti gli animali manifestano tendenzialmente un’aggressività per la sopravvivenza (per il cibo, il territorio e l’accoppiamento), che pero’ viene regolarmente mitigata, per esempio, attraverso gesti ritualizzati e strategie di riconciliazione che impediscono di fatto l’uccisione di animali della stessa specie (5). Fino ad ieri ricercatori e senso comune davano rilievo al primo aspetto (aggressività), oggi etologi, antropologi, psicologi e sociologi (non ancora il senso comune) credono che sia il secondo aspetto, la cooperazione, a controllare l’interazione nel gruppo. Lo stesso Uomo, come sostiene attualmente l’etologo Eibl Eibesfeldt (6), a differenza delle posizioni di Eric Fromm (7), possiede potenzialità genetiche istintuali almeno in ugual misura degli animali e di esse e’ possibile trovare traccia e significati nel corso della sua evoluzione: l’uomo non nasce tabula rasa e per buona parte il suo comportamento e’ controllato dalla biologia, almeno in termini potenziali ed è, forse, nella biologia e nell’inconscio, che sono incise le strategie per salvare il mondo. L’aggressività svolgerebbe così anche per l’uomo un ruolo fondamentale nel promuovere la cooperazione (8). Le stesse strategie di riconciliazione allora avrebbero nell’uomo profonde radici e non sarebbero riconducibili al “trionfo della ragione sull’istinto”, come spesso si dice. Per quasi tre milioni di anni l’uomo ha vissuto in piccoli gruppi nomadi (poche decine di individui) a semplice economia di caccia e raccolta e le pressioni selettive di questa esistenza, fondata, come aspetto centrale, sul rito della divisione del cibo e su altre interazioni sociali a comportamento altruistico e ad alto vantaggio genetico (Reciprocal Altruism Theory) (9), sono state le responsabili della “costruzione” del cervello umano attuale, cosi’ adattabile e creativo.

Questa economia innescava una forte selezione a segnare, forse anche in senso junghiano (10), l’inconscio profondo di esperienze tipiche, milioni di volte ripetute. Esperienze e comportamenti correlati a:

1 – una profonda collaborazione e cooperazione reciproca, non di tipo passivo o normativo, ma a forte identificazione al gruppo, che poteva cosi’ muoversi all’unisono nelle scelte: partecipation mystique al gruppo piuttosto che al territorio; l’interesse individuale coincideva profondamente con quello del gruppo: “se vi fosse un gene per l’altruismo”, afferma Dobzhansky (11) “la selezione naturale potrebbe agire contro di esso a livello individuale, ma favorirlo a livello di gruppo“; fu quello che successe;

2 – una probabile assenza di lotte sanguinose fra gruppi, per la completa mancanza di vantaggio complessivo per il vincitore: la perdita anche di un solo individuo nel gruppo vincitore poteva danneggiare irreversibilmente la caccia futura, contraddicendo la “Legge Assoluta della Riproduzione” (5); il rischio non valeva il bottino di guerra (rapporto con l’Altro da noi);

3 – una profonda armonia con gli altri esseri viventi e con l’ambiente esterno; la stessa sopravvivenza del gruppo richiedeva tale rispetto, volto a conoscere il luogo e il tempo della raccolta per le diverse piante, il periodo della loro maturazione, la quantità da cogliere per la sopravvivenza del gruppo e della stazione botanica, il comportamento, i cicli e le abitudini delle prede animali, addirittura considerate in un rapporto magico di vita-morte col gruppo (rapporto con l’oggetto esterno);

4 – una inessenzialità dei beni materiali, di oggetti ridondanti di ornamento e di scambio, da sempre simboli del benessere sociale. Una volta raggiunto, circa quarantamila anni fa, lo stadio finale dell’Homo sapiens sapiens, si aprono tutte le possibilità culturali. La capacita’ di possedere una Cultura coniugata al potente cervello costruito, permette l’elaborazione di questa in mille forme diverse e pittoresche. Solo diecimila anni fa, un tempo troppo breve per determinare ulteriori modifiche cerebrali significative, cominciarono, con l’invenzione dell’Agricoltura e la pratica dell’Allevamento, gli insediamenti umani permanenti, con i relativi “fili spinati” al confine e il concetto di proprietà, con l’accumulo di beni materiali superflui e l’incremento dello scambio e del commercio, ma in principal modo con la guerra. La guerra divenne possibile perché ora vi fu qualcosa per cui combattere: l’appropriazione dei raccolti del vicino poteva permettere la crescita di numero del popolo vincitore e la sua espansione rispetto alle perdite, grazie al surplus alimentare conquistato in battaglia (criterio spesso usato nei giochi storici di simulazione). La guerra divenne possibile come fallimento dello scambio e della transazione (Claude Levi-Strauss). La guerra divenne possibile per la tendenza alla perdita di unita’ e coesione del gruppo sottoposto a forze centrifughe di smembramento: si salva la coerenza interna, inventando lo straniero e il nemico (12). “In ogni caso“, affermano Piero e Alberto Angela (13) “sara’ soprattutto con la nascita della difesa dei beni (e quindi con la vita sedentaria e agricola tipica del Neolitico) che si svilupparono le occasioni di conflitto. E quindi probabilmente anche la violenza. Col concetto di proprietà si accresce appunto anche quello di appropriazione con furti e razzie“. Tracce del primo vero e inconfutabile massacro si rinviene proprio nel Neolitico nel Sud-Est della Francia, dove vari scheletri di uomini, donne e bambini portavano all’interno ancora conficcate le punte di numerose frecce neolitiche. Fu infine con l’insediamento permanente che si presento ‘ la necessita’ di inventare strutture sociali per risolvere le controversie, ponendo le basi per la formulazione di norme del Diritto, in nome del quale, in argomentazioni fredde e scarsamente controllate dai valori archetipici, saranno commessi nella Storia i più efferati genocidi.

Da allora in poi la spirale culturale, più che l’evoluzione biologica, inizio’ a ruotare a velocità sempre crescente attraverso l’Agricoltura, l’Industria, fino alla tecnologia avanzata dell’Epoca Moderna: Dobzhansky parla di passaggio dall’evoluzione biologica a quella culturale di tipo lamarkiano (14). Se prima l’uomo cambiava i propri geni a seconda delle esigenze dell’ambiente, potè pervenire ora a questo adattamento cambiando l’ambiente per accordarlo con i suoi geni (Dobzhansky (11) ), ostacolando il loro sviluppo. L’Uomo, pur capace di sfuggire alle vicissitudini dell’ambiente, costruendo asettici mondi fenomenici sempre più complessi e articolati, ne rimaneva coinvolto fino alla drammatica fase attuale di non essere più in grado di controllarlo, ponendo le condizioni per l’autodistruzione. L’intelletto umano “non e’ fatto per capire i sistemi sociali umani” (15), perché “le nostre forme di percezione innate sono state selezionate nel modesto ambiente causale dei nostri antenati primitivi” e non sono più “all’altezza delle responsabilità che la Tecnocrazia si arroga nel mondo in cui viviamo” (16). Gli adattamenti filogenetici che ci hanno plasmato sono ancora quelli del Paleolitico: con la cultura ci siamo costruiti un mondo per il quale non siamo ancora biologicamente ‘fatti’ (6). Il fatto però che non siamo più in grado di controllare i nostri mondi, previsti da sofisticati modelli simbolici, nei quali la ragione si è sbizzarrita fino in fondo, non significa che i nostri istinti siano indirizzati a comportamenti negativi sul piano umano, anzi, è la mancanza totale di umanità in quei mondi artificiali che obnubila l’umanità profonda presente negli istinti! Tutto ciò che è capace di rivitalizzare questo bagaglio di tendenze primordiali alla cooperazione e al rispetto universale (BIOFILIA ESTESA) – riti di caccia, immersione nella Natura con i riti di raccolta, immedesimazione nel Creato… – fa parte delle strategie vincenti per il futuro. L’affermazione di E. Morin (17) che “le forme a priori sotto il profilo ontogenetico sono a posteriori sotto quello filogenetico”, una specie di legge di Haeckel sul piano mentale, verrebbe a significare quindi che le teorie e i modelli “inventati” dal cervello umano sono in grado di funzionare ed adattarsi (fitting, ma non matching (18)), in termini di comprensione, spiegazione e modifica, al mondo – alla cui evoluzione lo stesso cervello era partecipe – attraverso un processo di dematerializzazione (19), mediato da sistemi di rappresentazione sempre più simbolici e codificati. Il fine ultimo di questo processo sembrerebbe essere la costruzione di un oggetto complesso dotato di memoria e percezione, che ricorda quel vertiginoso concentrato magico del mondo che e’ la monade leibniziana. Dire questo pero’ non vuol significare che questa congerie di materia e spirito risulti in armonia col Creato, viste le infinite strade percorribili ad ogni stadio,implicanti continue scelte (“se hace camino al andar…. Caminante, no hay camino, sino estelas en la mar” A. Machado (20)). Solo rivalutando la causa finalis, che evoca e riassume le tendenze profonde della nostra umanità – e non col solo apporto del nostro pensiero “causale uni-direzionale” (causa efficiens) – e’ probabile trovare una soluzione. Vi sembra che i prodotti della ragione siano in armonia col creato? La ragione semplifica, separa e distingue, il Creato è “il Complesso”; qualsiasi sentiero la ragione vi tracci, apporterà disturbo!

ALCUNE CONSIDERAZIONI EDUCATIVE

L’uomo di oggi, l’uomo simbolico, l’uomo che manda navicelle per esplorare pianeti e lo spazio, che rende coltivabili i deserti, ma che puo’ fare anche il contrario, data l’adattabilità e la flessibilità del suo potente cervello, come gettare bombe all’idrogeno o al neutrone, rischiare esplosioni di centrali nucleari, inquinare fiumi e sorgenti, desertificare intere aree tropicali e subtropicali… quell’uomo ha dentro il capo lo stesso cervello, in qualità e quantità, del piccolo cacciatore-raccoglitore nostro lontano progenitore, con le stesse pulsioni profondamente impresse, la stessa tendenza al rispetto del gruppo, lo stesso affetto per i piccoli, la stessa profonda reverenza magica per il pianeta che lo ospita e per l’energia che utilizza (i famigerati istinti atavici!). Nessun istinto negativo quindi, ma una potenziale predisposizione alla piena consapevolezza critica che, nonostante tutto, facciamo parte essenziale dei grandi equilibri naturali. Questa propensione umana alla cooperazione spontanea e partecipata di gruppo non dovrà essere più utilizzata per “radunarsi intorno alle bandiere”; questa spinta primordiale, questo profondo archetipo del rispetto dell’Altro da noi e dell’Oggetto esterno, e’ giusto che venga incanalato in uno sforzo universale per il riscatto dell’umanità, prima che sia troppo tardi. Non solo siamo un unico genere e un’unica specie, ma siamo anche un’unica sottospecie, per alcuni ricercatori, Homo sapiens sapiens, siamo un unico popolo; le varie mille culture diverse e pittoresche non devono essere interpretate nel senso della divisione e classificazione, perché sono l’indice preciso ed inequivocabile dell’appartenenza completa di quei popoli alla specie umana. Ogni gruppo non deve considerare se stesso diverso dagli altri in virtù delle diverse infrastrutture culturali artificiali piu’ o meno imponenti, ne’ tanto meno assumere queste differenziazioni ad alibi per superare l’istinto originario del rispetto degli individui della stessa specie, fino a considerare gli altri non-umani e quindi sopprimerli con la guerra (12). Dove c’e’ Cultura li’ c’è l’Uomo. Il rapporto sintonico, armonico e umile col pianeta, ancora preziosa e lontana eredita’ biologica del nostro piccolo antenato, cacciatore, raccoglitore e artefice di utensili su ciottolo, e’ la nostra seconda carta da giocare; il tempo per giocarla sta scadendo: dobbiamo fare in fretta e senza fare sbagli! Sbagli in effetti vengono commessi continuamente anche a bassi livelli, legati all’intervento o al non intervento di fattori umani: ora perché si ignorano certe situazioni, ora perché se ne indicano altre che sono solo marginali. Basta guardarci intorno. Cosi’ nei cicli perversi che presiedono ai processi di desertificazione progressiva di aree subtropicali, oltre alle coordinate di natura climatica, incidono fortemente le decisioni umane relative ad a) uno sfruttamento agricolo sbagliato (monoculture, mancanza di rotazione agricola…), b) un incremento non controllato della pastorizia, c) azioni di deforestazione legate al commercio, all’apertura di strade ed autostrade, ai processi di espansione dei campi lavorati, all’eliminazione dei fossi di alberi e arbusti che separano i campi…. Siamo arrivati addirittura a voler proibire quelle uniche attività (caccia e raccolta), radicate profondamente nella memoria biologica umana, la cui pratica, nella condivisibilità e nella partecipazione ai suoi riti (divisione del cibo…), potrebbe favorire quei processi educativi atti a comprendere i suggerimenti profondamente impressi nell’animo umano dal processo evolutivo. Le ragioni sostenute per l’abolizione di tali attività non sono forse dovute ad aver disconosciuto per troppo tempo i contenuti educativi archetipici di queste stesse attività? E neppure e’ pensabile sostituire caccia e raccolta con esperienze fortemente mediate come simulazioni in rappresentazioni teatrali o al computer (giochi di simulazione sulla caccia): le caratteristiche rilevanti di questi riti non sono mai trasferibili in modelli simbolici, lontani dal contatto diretto con la Natura. Queste importanti attività naturali rivisitate e inserite in un discorso educativo, anche a livello dell’Educazione Permanente, potrebbero neutralizzare gli effetti delle tendenze estranianti del vivere in un mondo innaturale (megalopoli, “società anonime” dove immense moltitudini di persone non si conoscono e quindi non si amano), indirizzando i giovani ad una formazione più consona alla loro natura profonda, forse contribuendo a risolvere, insieme ad altri interventi (P. Pistoia (21)), anche il grave problema della crisi dei Valori. Le attività del Cercatore-Raccoglitore e del Cacciatore insomma dovranno far parte essenziale, per i loro contenuti archetipici catalizzanti, del sistema di atteggiamenti e progetti (il nuovo sistema di riferimento, che dovranno essere messi in atto in breve tempo per salvare il Mondo. Sembrerà assurdo – e ciò che sembra assurdo va guardato con estrema attenzione, perché qui forse sta la via giusta per uscire dalla trappola (22) – ma saranno proprio gli ISTINTI e la CACCIA, oggi rifiutati come aspetti negativi e attività riprovevoli da limitare e soffocare, a darci un barlume di speranza: ricordiamoci che nessuno sa quanto bene esista ancora in ciò che viene indicato come male (23) e quanto male ha commesso il bene e non solo nel passato (enantiodromia eraclitea)! Purtroppo l’Uomo simbolico ha la presunzione, in un prossimo futuro, di sostituirsi alla cieca forza della selezione naturale (ingegneria genetica), secondo direttrici fondate sui suoi presunti “valori” e sulla sua presunta conoscenza della natura. Alla luce dei dati che oggi abbiamo pero’ rimane aperto il dubbio se la specie umana possa assumersi tale incarico, a meno che non si provveda in termini educativi opportuni; in effetti “c’è un abisso fra i valori e gli ideali di cui tutti parlano e la maniera in cui tutti vivono (11). Uno dei piu’ grandi antropologi oggi vivente, R. Leakey, terminava il suo stimolante libro, “Origini” (24), con questa amara considerazione: “Essere arrivati su questa terra, come risultato di un accidente biologico, solo per doverla lasciare a causa dell’arroganza umana, sarebbe il massimo dell’ironia“.

BIBLIOGRAFIA

1 – N. CACACE “Quarto capo di imputazione” da ‘Processo alla Scuola’, Atti Convegno, 1986.

2 – K. R. POPPER “Conoscenza Oggettiva” Armando, 1975.

3 – LASCK “La Cultura del Narcisismo” Bompiani, 1983.

4 – A. VISALBERGHI “Educare alla complessita’ del reale” da SCUOLA E CITTA’ 31-Gennaio-1987, Nuova Italia.

5 – F. JACOB “La logica del Vivente” Einaudi, 1971.

6 – E. EIBESFELDT “Etologia dell guerra” Boringhieri, 1983.

7 – E. FROMM “Anatomia della distruttivita’ umana” Mondadori, 1975.

8 – F. de WAAL “Far la pace fra le Scimmie” Rizzoli, 1990.

9 – R. TRIVERS “Social Evolution” Benjamin/Cummings, 1985.

10- A PAGNINI “Psicanalisi ed Estetica” Sansoni, 1975.

11- T. DOBZHANSKY et al “L’Evoluzione e la specie umana” da SCIENTIFIC AMERICAN, Zanichelli, 1968.

12- R. GUIDUCCI “Divieto genetico e licenza di uccidere” e P. CLASTRESS “La guerra nelle societa’ primitive” da ‘UOMINI E LUPI’, Volonta’, 1990.

13- P. e A. ANGELA “La straordinaria storia dell’Uomo” Mondadori, 1989.

14- T. DOBZHANSKY “Evoluzione della specie umana” Einaudi, 1965. 15- J. FORESTER “Principi dei Sistemi” Etas Libri, 1974.

16- R. RIEDL “Le conseguenze del pensiero casuale” da A. V. “La realta’ inventata” Feltrinelli, 1989.

17- E. MORIN “La Conoscenza della Conoscenza” Feltrinelli, 1989. 18- E. von GLASERSFELD “Introduzione al costruttivismo radicale” da A. V. “La realta’ inventata” Feltrinelli, 1989, pag. 17-35.

19- O. MARZOCCA “Filosofia dell’Incommensurabile” Franco Angeli,1989.

20- M. CERUTI “La danza che crea.Evoluzione cognizione nell’epistemologia genetica” Feltrinelli, 1989 pag. 11.

21- PIERO PISTOIA “Il mondo della Scuola e il mondo del Lavoro: un rapporto difficile” da LA RICERCA 15 Ott. 1987, Loescher.

22- A. V. “La realtà inventata” Feltrinelli, 1989.

23- P. FEYERABEND “Addio alla Ragione” Armando, 1990. 24- R. E. LEAKEY e R. LEWIN “Origini” Laterza, 1979.

(Dott. Piero Pistoia)

____________________________________________

3-Piero Pistoia_EVOLUZIONE: UN IPOTETICO SCHEMA EVOLUTIVO

EVOLUZIONE: UN IPOTETICO SCHEMA EVOLUTIVO UMANO a cura del dott. Piero Pistoia

(RUMINAZIONI RIMASTICAZIONI MODIFICHE AGGIORNAMENTI)

La bibliografia verrà fornita in itinere o aggiunta al termine del lavoro

RIASSUNTO

Senza entrare nel dibattito sulle teorie relative all’Evoluzione (1) e sui loro paradigmi (Darwinismo, Neodarwinismo e Teoria Sintetica, Teoria Anti-evoluzionista di Sermonti e Fondi, Teoria degli equilibri punteggiati di Eldredge e Gould, ecc.), nè sulle interpretazioni multiformi della filetica umana (2), abbiamo all’inizio tracciato uno dei possibili percorsi evolutivi dell’uomo, che risponde, insieme ad altri, alle richieste dei fossili e strumenti umani attualmente conosciuti, focalizzando, in qualche punto cruciale di questa trattazione standard, alcuni problemi e punti interrogativi aperti del processo, formulando ogni tanto ipotesi alternative.

PRECISAZIONI INTRODUTTIVE

-La Natura è soggetta spesso a esplosioni rapide di carattere fisico-geologico improvvise che possono determinare cambiamenti nelle popolazione di flora e fauna in “brevi intervalli di tempo” se confrontati ai tempi medi coinvolti in quei fenomeni. Per es., eruzioni vulcaniche, terremoti (elastic rebound theory) con movimenti o spostamenti verticali di placche territoriali, caduta di meteoriti… e in particolare modificazioni climatiche rapide.

-Quando le strutture biologiche in evoluzione vengono a trovarsi in situazioni di tensione improvvise di natura casuale si possono avere, per es., rapidi invecchiamenti ovvero loro eccezionale e rapida evoluzione. In particolare i cambiamenti climatici possono frammentare rapidamente le popolazioni degli Ominini, creando piccoli gruppi in cui le novità genetiche in prima istanza e le culturali in seconda, potevano rapidamente consolidarsi, accelerando la speciazione, o b) attivare diffusioni delle popolazioni degli Ominini secondo direttrici spesso condizionate da quei fenomeni, c) ovvero la loro estinzione.

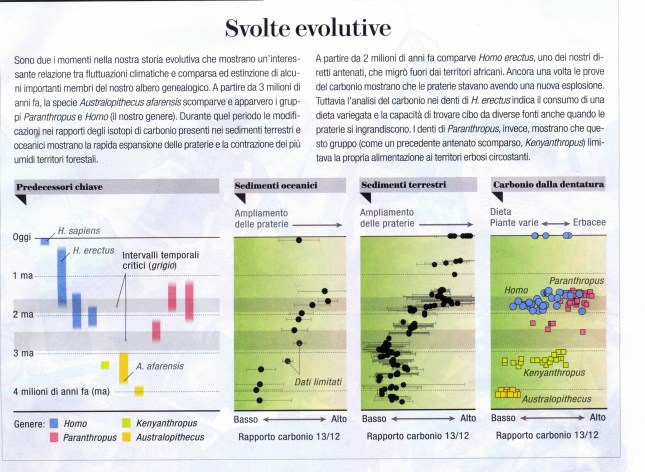

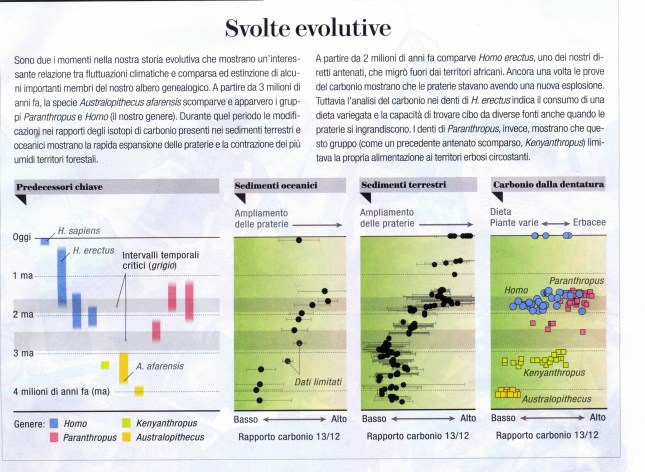

-La ricerca di queste correlazioni iniziano ora ad essere possibili con lo svilupparsi di nuovi metodi e processi tecnico-scientifici, in particolare attraverso rapporti isotopici su opportuni composti mirati. (LE SCIENZE it., novembre 2014,; art. “Shock climatici”, P. b. dMenocal)

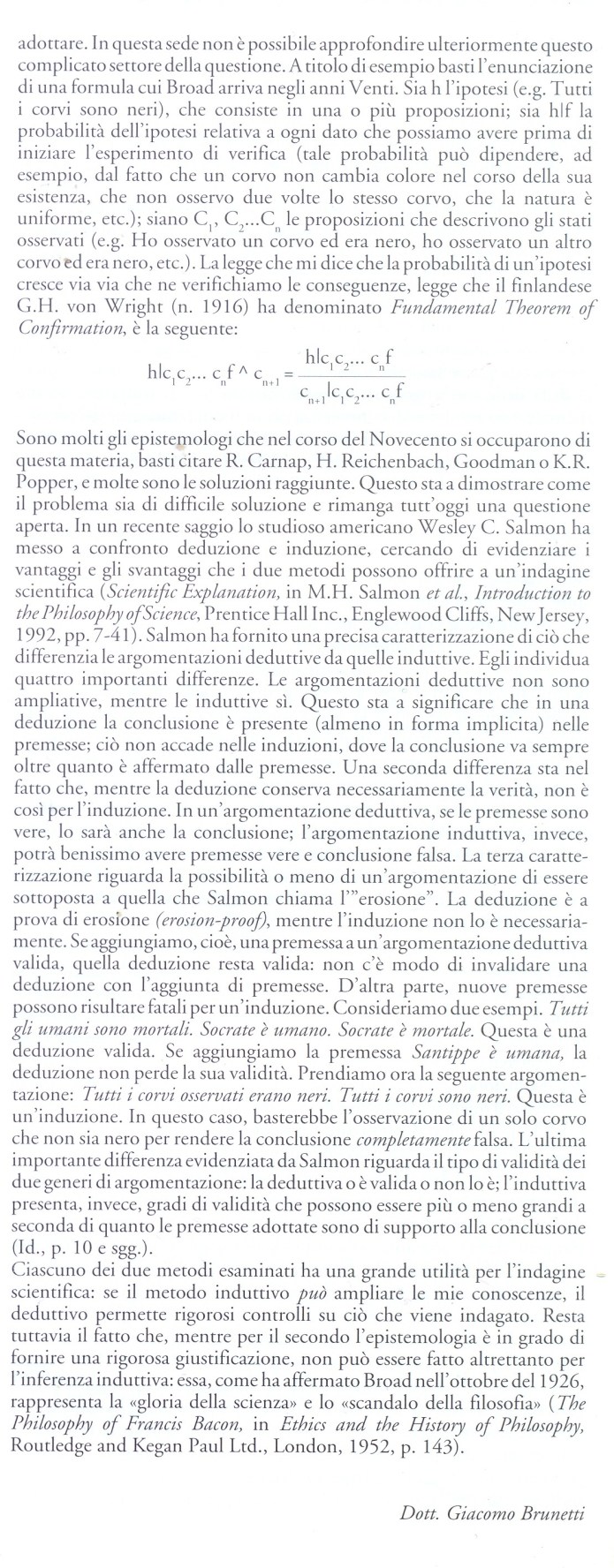

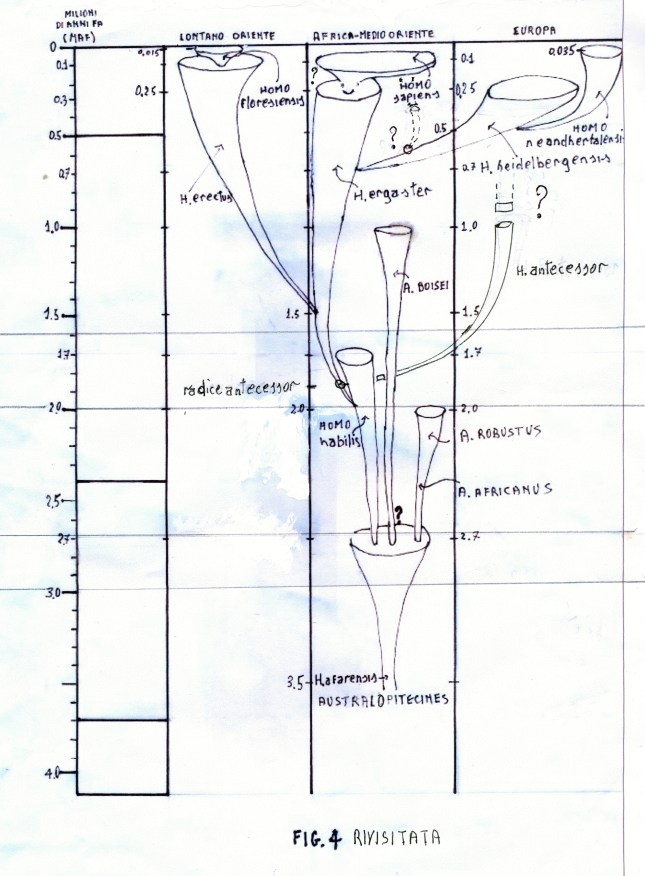

-Per quanto riguarda i “Predecessori chiave” dell’albero filetico dell’Homo, vedere la figura a pag.55 del’art. nominato sopra, dove sono evidenziate per gli antichi progenitori del sapiens due strisce critiche per “esplosioni” evolutive, fra (3 e 3 .8)ma, e fra (2.0 e 1.6)ma; per lo stesso scopo, vedere anche la FIG. 4 RIVISITATA di questo articolo.

EVOLUZIONE RECENTE PER FATTORI BIOLOGICI E CULTURALI (cenni)

in via di sviluppo

evul_mutazioni4 -> link esterno

ALCUNE CONSIDERAZIONI SULL’ORIGINE DEGLI HOMINIDI (3)

La fase antichissima dell’evoluzione umana è da ricercarsi nell’Africa Orientale, da forme di Primati con strutture non ben definite o miste, con possibilità di evolversi verso la brachiazione o verso la bipedia a seconda dell’ambiente.

Consideriamo Ominidi (famiglia: Hominidae) l’uomo, le scimmie antropomorfe africane e rispettivi antenati (mentre l’uomo ed i nostri parenti estinti di tipo umano sono inclusi nella sottofamiglia degli Ominini).

La storia evolutiva dell’uomo si inserisce così in quella lontana dei Primati (proscimmie, scimmie s.l. e scimmie antropomorfe). Alla fine del Mesozoico (circa 65 MAF), qualche evento catastrofico che arricchi di iridio i sedimenti del tempo, insieme all’estinzione dei dinosauri, ridusse fortemente anche le altre forme viventi sulla terra. Piccoli mammiferi arboricoli e insettivori riuscirono a sopravvivere, dando inizio alla radiazione adattiva dei Primati (esplosione di forme scimmiesche da una medesimo antenato comune).

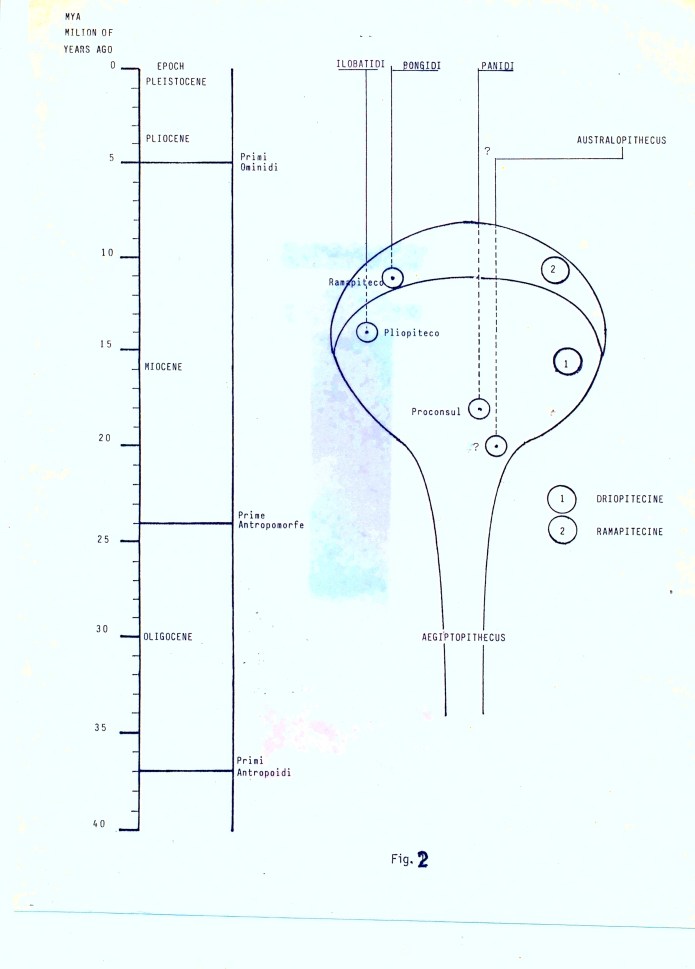

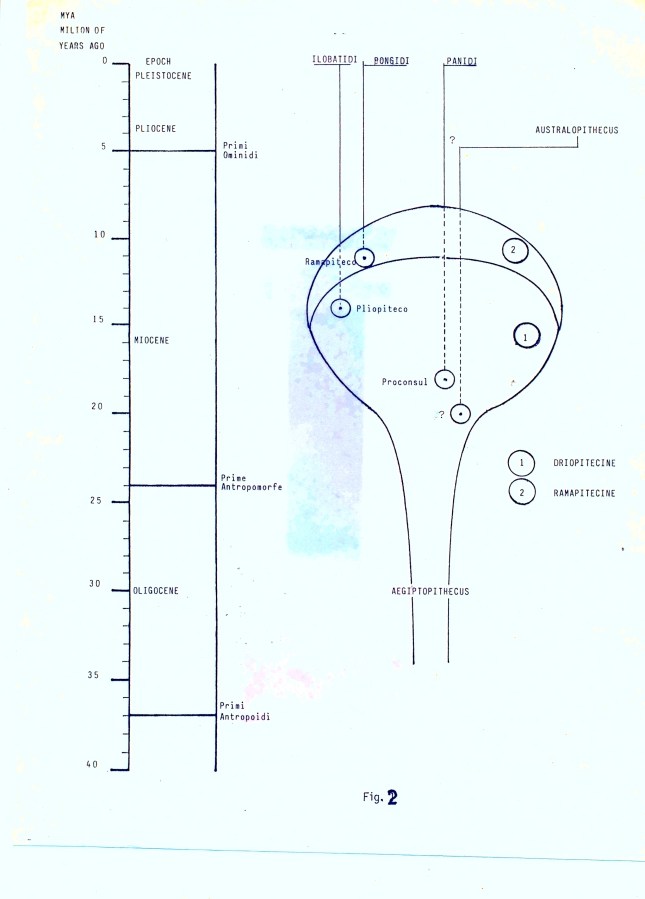

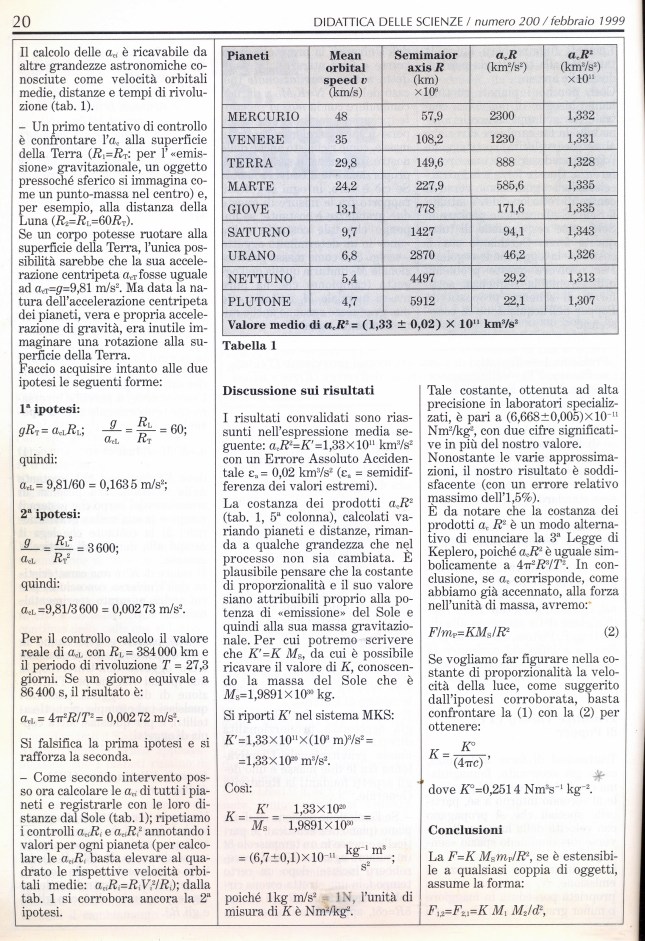

L’Aegiptopiteco (Fig.2) dell’Oligocene Sup. ( intorno a 30 MAF) o gruppi vicini potrebbero essere considerate le forme ancestrali dei vari primati miocenici (Driopitecine e successivamente Ramapitecine), forme antropomorfe (le cui radici apparirono 14-15 MAF, a cavallo fra Oligocene e Miocene) che esplodono appunto a partire dal Miocene medio (20 MAF), raggiungendo il massimo a 15 MAF per ridursi drasticamente nel Miocene sup, intorno agli 8 MAF (Fig.2). Fra queste forme dovremmo individuare i precursori, fra l’altro dei Pongidi (scimmie antropomorfe asiatiche: Orangoo Orangutang), dei Panidi (scimmie antropomorfe africane: Pan o Scimpanzè e Gorilla), e degli Ilobatidi e forse degli Ominidi in Africa.

Le trasformazioni evolutive delle diverse linee dei Primati non umani e degli Ominidi sono, come accennato, da mettere in relazione con l’Habitat e possono essere interpretati come risposte alle mutate esigenze alimentari e alle condizioni di vita diverse.

Infatti sull’intero pianeta nel periodo Miocene medio-Pliocene, continua il grande corrugamento alpino, si verificano movimenti di zolle di crosta , si chiude il bacino del Mediterraneo (l’antico mare Tetide), si forma la grande fossa tettonica del Rift-Valley in Africa orientale (Dall’Eritrea al Malawi). e, contemporaneamente, si verifica un notevole cambiamento climatico, con diminuzione della temperatura, clima secco e riduzione dell’area forestale in specie nelle zone temperate attuali, che dopo un lungo periodo di clima equatoriale, rientrano nella fascia tropicale e sub-tropicale.

In particolare anche nelle regioni dell’Africa (teatro del nostro interesse) , a oriente, nel Rift-Valley, fossa lungo la quale si estendeva l’areale più importante degli Ominidi, durante gli sconvolgimenti geomorfologici e quando il monsone atlantico portava umidità nelle regioni occidentali dell’Africa, ma non nelle orientali, si riduce, a partire da 17 milioni di anni fa la foresta e si forma un paesaggio aperto, mentre ad ovest l’ambiente continua ad essere umido ed alberato. La foresta ad est del Rift gradualmente così si trasforma in savana e poi in prateria, in cui possono trasferirsi i Primati arboricoli che hanno qualche capacità di adattamento ad un ambiente aperto, pieno di pericoli, con possibilità di alimentazione più povera e di natura frugivera (semi, bulbi, radici, insetti). Potevano essere favorite così forme in grado di realizzare, fra l’altro, anche se temporaneamente, un raddrizzamento del corpo (tendenza evolutiva verso il bipedismo), una riduzione dei canini e un aumento delle dimensioni dei molari (tendenza evolutiva alla modifica dell’apparato dentario), mentre altre antropomorfe potevano continuare ad abitare la foresta ed altre ancora estinguersi.

IPOTESI ‘TENTATIVE’ (TT DI POPPER) SUI POSSIBILI PROGENITORI ANTROPOMORFE-OMINIDI (a partire da una trentina di milioni di anni fa) in via di aggiornamento.

Qualche decina di anni fa sembrò plausibile che da un gruppo di queste antropomorfe mioceniche (Driopitecinae), in un’epoca non ben precisata, si sarebbero evoluti poi gli Hominidi. I Driopiteci abitatori della foresta, che avevano invaso il continente europeo ed asiatico, iniziarono a declinare verso 12 MAF ovunque, mentre i ramapiteci (con un apparato dentario sulla base del quale Leakey assegnò anche un’andatura tendenzialmente bipede), si espansero in ambiente meno forestale in Asia ed in Europa tra 14 e 8 MAF, mentre in Africa a partire da 16.5 MAF.

I rapporti filetici fra Ramapiteci, Driopiteci, altre forme ipotizzate di antropomorfe meno specializzate, il ramo delle Antropomorfe viventi ed il philum umano non sono ben conosciuti, a causa di lacune temporali e geografiche e della frammentarietà nei fossili, per cui gli specialisti sono spesso in dissenso sul probabile comportamento e sui rapporti delle specie fossili.

Alcune decine di anni fa Leakey (13) e Coppens (2) ritenevano che la separazione degli Ominidi dalle Antropomorfe fosse avvenuta in Africa Orientale e risalisse al Miocene Medio (almeno 12-14 MAF). Da quel momento si sarebbe formata una linea evolutiva, a partire da qualche forma ramapitecina ( es., Keniapithecus wicheri, il più scaltro (?) fra i Ramapiteci) tendente verso la forma umana, parallelamente alle altre forme allora viventi. Rimaneva così un intervallo vuoto di milioni di anni prima dell’apparizione di forme a stazione eretta simili all’uomo. E ancora, escludendo dalla linea dell’Uomo i Ramapiteci più specializzati e accettando con Lumley (3) che nel”Miocene l’evoluzione delle Antropomorfe è praticamente conclusa con l’adattamento perfezionato alla vita arboricola”, la popolazione origine del phylum umano, dello stesso ceppo dei Panidi, doveva essere ricercata prima della specializzazione delle Driopicine, quindi più di 20 MAF (Fig.2), in forme periferiche e poco numerose che vivevano al limite della foresta, forse vicine ai Proconsoli.

Alcuni dissero che il punto della questione non era tanto la presenza di una lacuna di fossili di Ominidi fra 6 e 4 MAF, quanto la loro mancanza totale (al tempo dello scritto) prima di 4 MAF!

“Il fatto che nessun fossile Ominide (del tipo degli Australopiteci) sia stato rinvenuto, al tempo dello scrivente, prima di 4 MAF, può indicare che la linea degli Ominidi non sia molto più vecchia di questa data” affermava Strickberger (1).

Da tempo era stata già formulato l’ipotesi che la linea dell’uomo era più vicina a quella dello Scimpanzè degli altri antropomorfi (una buona intuizione). Dati genetici e biomolecolari lo hanno confermato: queste due specie hanno in comune ben il 98% di DNA. Da questi studi deriva anche che il loro antenato comune doveva vivere in Africa intorno a 6 MAF (per il Gorilla, intorno a 7-8 MAF; per l’Orangutang, intorno 14 MAF). Da 8 a 4 MAF sembrava vi fosse un vuoto di forme fossili in particolare quelle antropomorfe. Negli ultimi 10 anni sono state scoperte anche due a tre forme di antropomorfe fossili che coprirebbero questo intervallo di tempo. Fra queste o fra le altre che scopriremo forse potremo trovare l’antenato comune cercato fra lo Scimpanze e l’Australopiteco, prima forma con la stazione eretta (tale radice dovrebbe aggirarsi fra 6-8 MAF), dopo cioè la scomparsa dei Ramapiteci.

BREVI CONSIDERAZIONI SULLA TEORIA DEGLI EQUILIBRI PUNTEGGIATI (un esempio simulato).

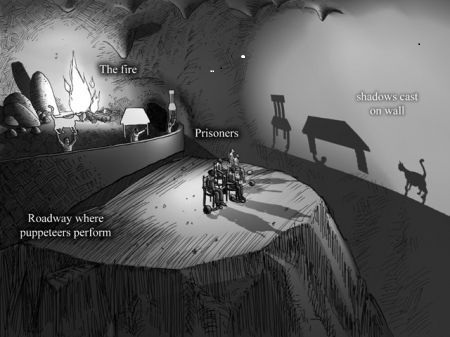

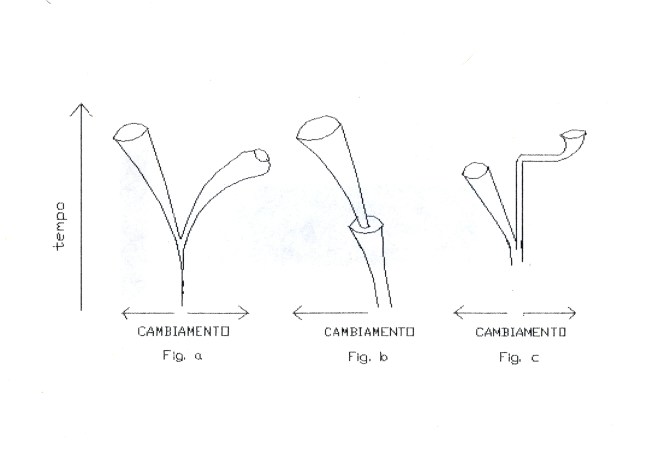

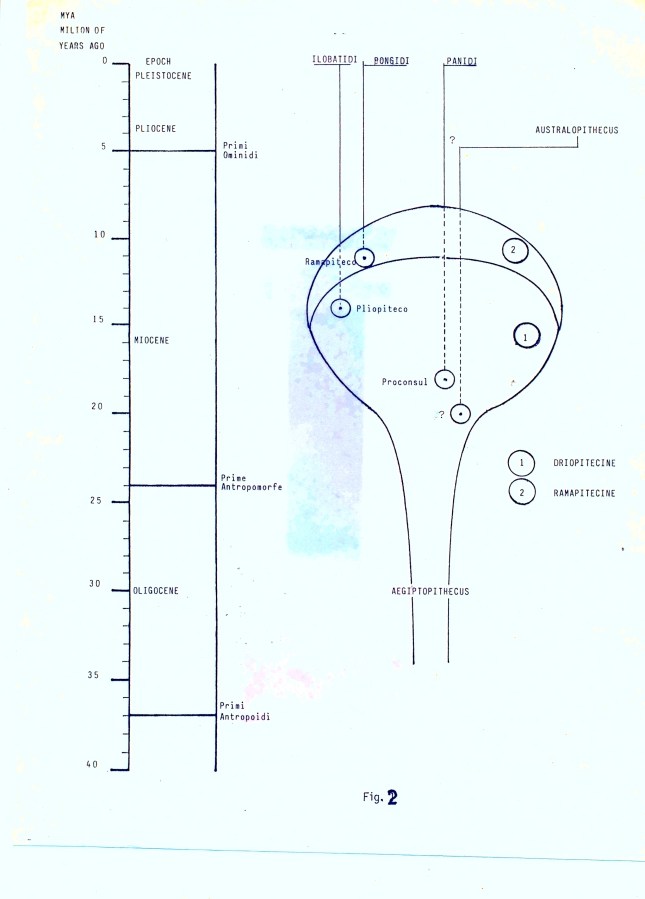

Ma la individuazione del phylum umano implica necessariamente una biforcazione? In effetti, in generale, nei passaggi evolutivi fra popolazioni si danno almeno tre possibilità di seguito accennate.

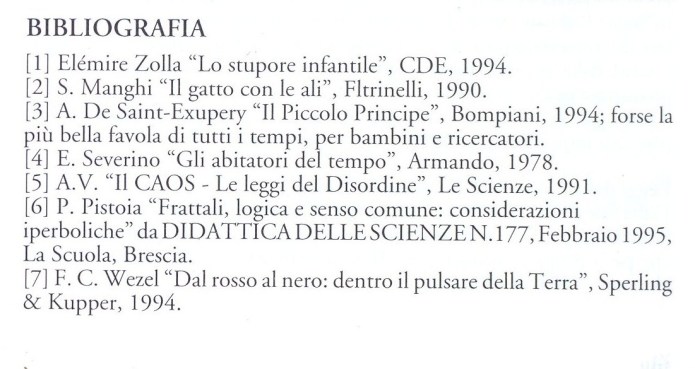

1 – Una parte della popolazione, per esempio, periferica e marginale, procede evolvendo in una direzione diversa dal resto; dopo un certo tempo potremo avere due gruppi contemporanei diversi, imparentati da un progenitore comune; si ha così una diramazione col successo probabile di uno solo dei rami (Fig.1a).

2 – Una popolazione evolve completamente in un’altra in maniera graduale (Fig.1b).

3 – Una parte della popolazione evolve, mentre l’altra, esempio, la periferica, continua a rimanere in forme indifferenziate anche per molto tempo; improvvisamente esplode in forme con piani strutturali completamente diversi (Fig.1c).

Fig.1

L’ALBERO DELL’ EVOLUZIONE UMANA: RAPIDE CONSIDERAZIONI ED ARGOMENTAZIONI E MOLTI INTERROGATIVI Al MARGINE IN CORSO DI AGGIORNAMENTO PERMANENTE (lo schema viene infatti continuamente modificato, anche in tempi brevi, dalle nuove scoperte di fossili)

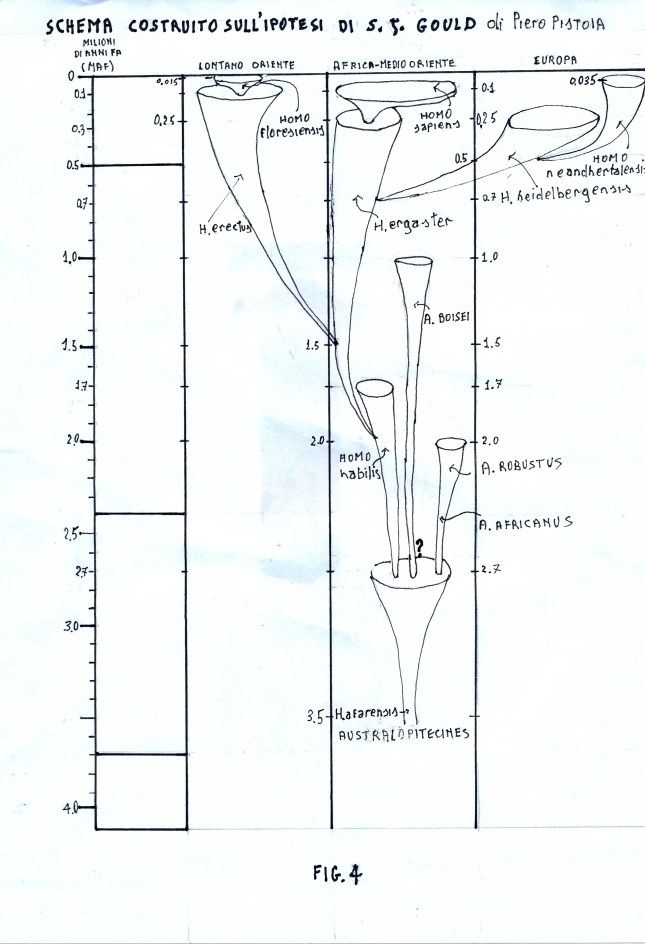

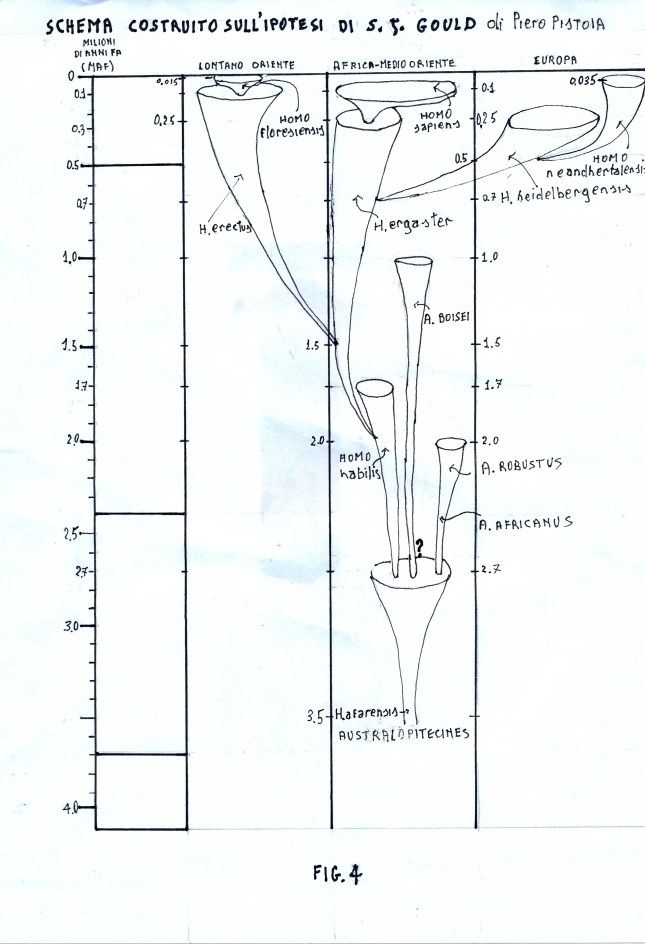

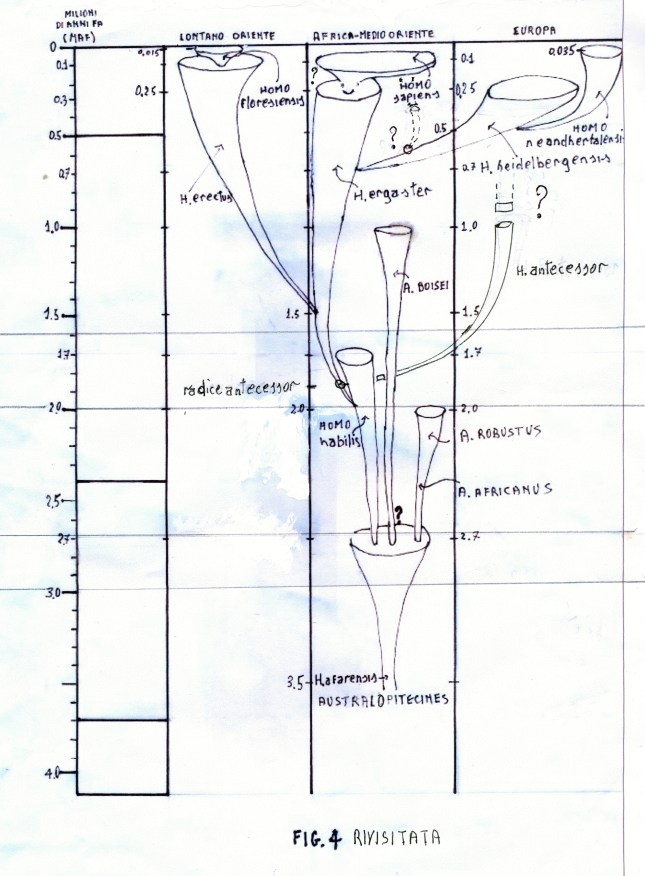

(Seguire il cammino sulla Fig.4 e Fig. 4 rivisitata)

ATTENZIONE! da correggere!

PROBLEMA; H.ergaster, H. antecessor, H. Heidelbergensis: rapporti in Europa

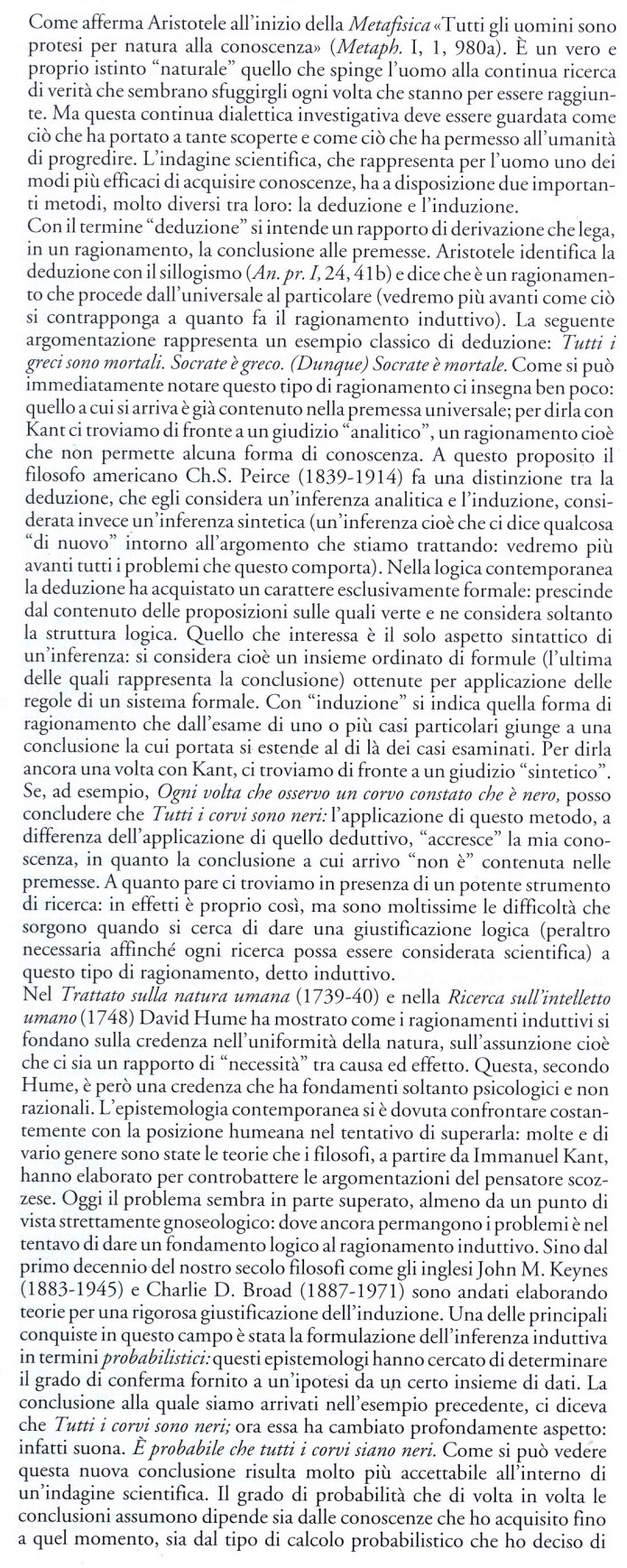

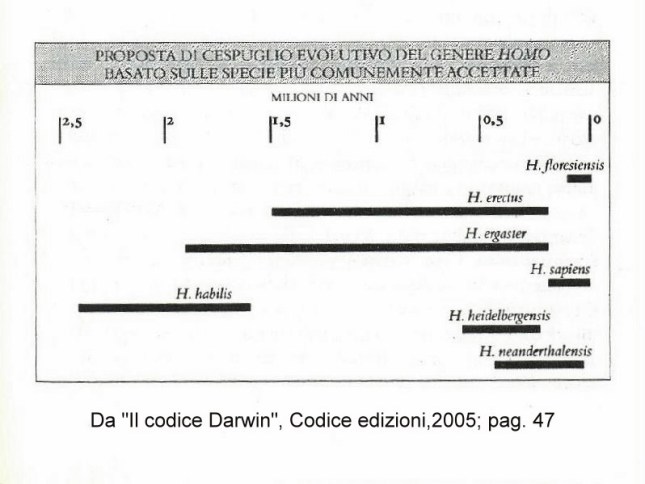

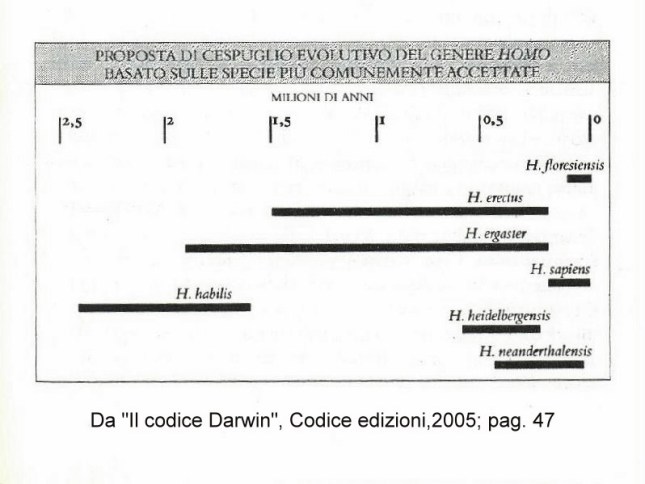

Nella evoluzione umana invece di invocare per lo più un lento ed inesorabile cambiamento di una specie longeva e ubiquitaria (albero con pochi rami), subentrò la convinzione di una convivenza di specie diverse (cespuglio evolutivo), che nel corso della loro vita sarebbero rimaste per la maggior parte del tempo immutate (albero filetico ramoso). Oggi si tende di nuovo a ‘potare’ di qualche ramo l’albero filetico del genere Homo. Per sapere più in profondità di quello che abbiamo scritto e di queste tendenze leggere “Il codice Darwin” di G. Biondi e O. Rickards, Codice Edizioni, Torino, 2005 e “Le origini dell’uomo” A. V., Le Scienze, 2005. – Nominando solo le specie più comunemente accettate, l’albero filetico dell’Homo, con radici africane (vedere figura sotto PROPOSTA DI SCHEMA DEL GENERE HOMO, di Gould), alla base è costituito plausibilmente da H. habilis, che visse in Africa e la colonizzò fra quasi 2.5 e 1.6 MAF.

Fig.3 (schema riportato da Gf. Biondi e O. Richards)

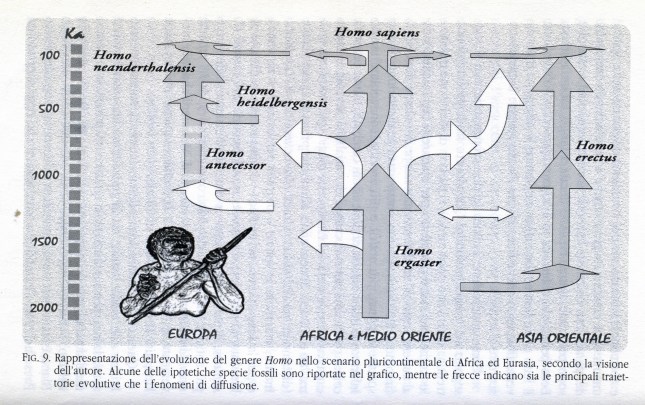

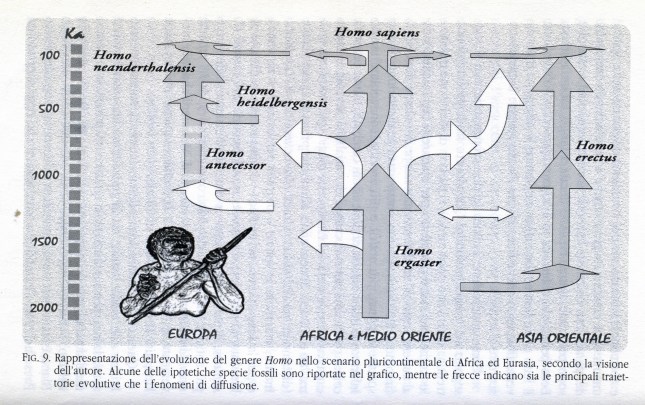

– Dall’habilis prese vita, circa 2 MAF, il ramo di H. ergaster, specie madre africana per tutte le forme che si sarebbero disperse in tutto il continente africano, europeo e asiatico. Due rami sfasati nel tempo diffusero, da radici su H. ergaster, infatti verso l’Europa: uno circa o.7-0.8 MAF e l’altro molto tempo prima circa 1.7-1.8 MAF (vedere Fig.4). Nel momento del ‘distacco’ il secondo (H. antecessor) possedeva la primitiva Cultura Oldowaiana (choppers e chopping tools, MODO 1) e l’altro (H. heidelbergensis), la Cultura Acheuleana, MODO 2 (attrezzo emblematico l’amigdala), che fu acquisita in tempi più recenti in Africa e si evolse fino a ‘partorire’ un figlio 200mila-150mila anni fa, in Africa Orientale (Etiopia), chiamato Homo sapiens arcaico (sembra termine oggi obsoleto). Il sua areale diffuse poi verso nord-est in Medio Oriente circa 100mila anni fa, in particolare in Israele e dintorni. Qui apparvero i primi ‘nuovi’ sapiens che uscirono dall’Africa, gli avi dell’intero genere umano, se escludiamo l’ipotesi di Multiregionalismo (più centri di evoluzione per l’Homo sapiens), oggi, sembra, non così obsoleta. Un’altra accreditata ipotesi, alternativa (?), sull’origine dell’uomo moderno (H. sapiens), considera il ramo dell’heidelbergensis nel tratto africano: intorno a 0.6 MAF popolazioni diffusero verso l’Africa Orientale ripetendo il racconto fatto prima, mentre l’ergaster, pur linea longeva, si estinse. Uno può vedere uno schema illuminante in G. Manzi “L’Evoluzione umana”, Il Mulino, 2007; Fig. 9 pag. 80, da confrontare con FIG. 4 RIVISITATA.

,

Dopo i ritrovamenti in Europa di fossili molto più vecchi di 700ka-800ka, venne pensata una diffusione verso l’Europa di un ramo da una radice di l’H. ergaster forse più antica di quella dell’erectus; quelle popolazioni di Homo furono nominate H. antecessor. La figura sotto è la Fig4 rivisitata.

FIG.4 RIVISITATA con ramo dell’antecessor

FIG. 5

SCHEMA DEL PROF. G. MANZI da ‘L’evoluzione umana’, Il Mulino

NB – Il curatore di questo post si è preoccupato di interpellare più volte tramite e-mail la redazione della rivista Le Scienze per avere la possibilità di far riferimento a grafici, foto e dati durante l’aggiornamento di questo intervento.

SULLA PRIMA E SECONDA ‘ESPLOSIONE’ DEGLI OMININI: UNA NUOVA IPOTESI

Peter B. deMENOCAL “SHOCK CLIMATICI”, Le Scienze, novembre 2014

A cura del dott. Piero Pistoia

Evul_shock_climatici3.odt in via di ampliamento

IL GRAFICO CHE SEGUE CON LA RELATIVA DIDASCALIA E’ TRASFERITO DALLA PAG. 55 de LE SCIENZE, NOV. 2014. RIPORTATO NELL’ARTICOLO del Prof. deMenocal

FIG: 6

OGGI (2015) SEMBRA DISPONIBILE QUALCHE DATO ‘DURO’ SULLA FILOGENESI DELL’UOMO, CIOE’ VIENE INDIVIDUATA UNA ‘SPECIE CHIAVE DELL’EVOLUZIONE UMANA’ – Appunti ripresi dalla lettura dell’articolo del paleontologo G. Manzi << I nostri antenati di “mezzo”>>riportato ne “Le Scienze”, novembre 2014.

L’articolo <<REQUISCAT IN PACE’ (RIP) for a key Human Species?>>, pubblicato in “Science”, che raccoglie il dibattito congressuale a Tautavel, sui Pirenei francesi e nominato dal prof. Manzi nel suo articolo (vedere sopra), viene interpretato come: ” C’è ancora tanto da precisare nell’albero umano, ma un punto ormai sembra sicuro! infatti…

In Africa ed in Eurasia sono stati rinvenuti fossili di ominini con caratteristiche ed età simili al fossile di Mauer (trovato a Heidelberg, Germania; di circa 500 ka) certamente con tratti morfologici diversi per la grande variabilità delle specie umane e per il vasto areale. I caratteri comuni a questo insieme di individui, oltre ad individuare un’unica specie di Homo, detto H. Heidelbergensis, escludono l’appartenenza a questa specie della maggior parte delle specie seguenti (Vedere FIG. 4 RIVISITATA):

H. sapiens; africano

H. erectus; estremo Oriente

H. ergaster; in particolare l’ultimo tratto del philum africano

H. antecessor; europeo

H. floresiensis; ‘hobbit’ dell’isola di flores, Indonesia

L’heidelbergensis sopravvisse in Eurasia ed Africa da circa 600 a 200ka.

Si conclude nell’articolo citato che questa specie viene a situarsi in ‘mezzo’ fra gli ominini più arcaici (quasi tutti quelli nominati) e le specie successive: il Neandhertal e l’Homo sapiens; tanto che è plausibile che l’Homo heidelbergensis si ponga, a mezza costa, come progenie delle specie arcaiche e come antenato per le due specie successive (Neandhertal e Homo sapiens). E l’uomo di Ceprano di circa 430 ka ? (vedere anche discussione successiva da modificare). In effetti potrebbe essere una forma dopo Mauer, sulla linea evolutiva dell’heidelbergensis al tempo di 430 ka (vicino alla separazione col Neandhertal o subito dopo)?

– Dapprima si pensava che i più antichi fossili degli ominini scoperti in Europa avessero un’età intorno ai 7-800mila anni (ancora prima solo di circa 500ka). Ora, con le nuove scoperte di fossili e loro datazioni, si sono moltiplicati i casi di una popolazione molto più antica (1.2-1.3 Maf), in particolare in Spagna nel sito di Atuaperca. Seguire sulla FIG. 4 RIVISITATA. Così sembra che in Europa ci siano state almeno due diffusioni dall’Africa a partire dall’ergaster africano sfasate nel tempo: una, più antica, dell’antecessor (radice: 1.5 MAF o più antica) e l’altra successiva dell’heidelbergensis (radice: intorno a 700ka), ambedue appunto dal ‘tronco’ dell’ergaster africano, ma, nel secondo caso, ormai già evoluto al modo 2. Gli ominidi europei del ramo più antico, es., della Spagna, H. antecessor, di Cultura Oldowaiana, (MODO 1), di lontana radice africana sul ‘tronco’ dell’ergaster antico, (es., strumenti litici di Bibbona, Tuscany, Italia, circa 730ka), nel procedere della loro evoluzione e diffusione verso est, potrebbero aver prodotto alcuni gruppi successivi, per es., anche al centro e nel sud Italia, (del tipo, per es., uomo di Ceprano, Argil, di almeno circa 400-450mila anni fa), e quindi contemporanei agli heidelbengensis diffusi dall’Africa, presenti in Europa a partire da 0.5-0.6 MAF. Tali gruppi, posti come discendenti sulla antica linea filetica dell’ergaster dell’Oldowaiano (cioè H. antecessor europeo) di radice lontana africana (diffuso verso l’Europa circa 1.5-1.6 MAF), per ipotesi, potrebbero essere precursori di qualche comunità o popolazione dell’altra linea dell’ heidelbergensis di MODO 2 (già nominata come diffusa dalla radice africana sull’ergaster, circa 0.7 MAF; presente in Europa a partire da circa 0.5-0.6 MAF), vista la grande variabilità all’interno delle specie umane (si pensi che un Pigmeo ed un Masai sono ambedue sapiens)? (Ma nel ‘quattrocentomila anni fa’, al tempo delle popolazioni simili al fossile di Ceprano, esisteva in Italia l’heidelbergensis di origine africana in evoluzione! Quindi, meglio, questi gruppi potrebbero essere i precursori di una forma italiana dell’heidelbergensis? Segue argomentazione sull’ipotesi. Da chiarire. (da rivedere!)

(Nel fossile di Ceprano (430ka) i caratteri fini sembrano rimandare ai contemporanei europei, cioè agli heidelbergensis e invece “non c’è nulla in lui che parli del Neandhertal” (National Geographics, Italia. agosto 2011). Ma la sua struttura piuttosto pesante è molto più antica e ‘guarda’ indietro ad Atapuerca in Spagna (H. antecessor, 1.2-1.3 MAF). Così il fossile detto Argil (rinvenuto in argilla) di Ceprano diviene candidato per essere un ipotetico antenato di una possibile popolazione di heidelbergensis italiani, d’altronde specie molto variabile, sulla linea evolutiva del popolo di Atapuerca?

Così intorno a 400ka in Ceprano sembra convivere il prodotto evolutivo delle popolazioni di H. antecessor di Atapuerca in circa (1.2-0.4)ka, insieme a popolazioni di H.Heidelbergensis, diffuse dall’Africa da una radice dell’ergaster vicina a quella dell’erectus.) da rivedere

– In Africa intorno a 600-700 mila anni fa apparve il ramo dell’Homo heidelbergensis, che si ritrova in Europa da 500-600mila a 250mila anni fa. Esso appena apparve già possedeva la Cultura delle asce a mano (le amigdale o asce senza manico), che portò con sé nella diffusione in l’Europa, dove questi utensili della Cultura Acheleuana MODO 2), associati a fossili di H. heidelbergensis, si ritrovano, per es., ad Arago in Francia, a Stheineim e Heidelberger in Germania ed a Swanscombe in Inghilterra (forse in successione temporale? Diffusero da occidente verso oriente?). Questa specie 250mila anni fa si estinse non prima di aver dato i natali al Neandhertal. Infatti dall’heidelbergensis ebbe origine, sembra, l’Homo neandertalensis di cultura Musteriana MODO 3, specie europea e dell’Asia occidentale, che visse fra 200mila e 30mila anni fa, coprendo l’intero Paleolitico Medio, . Quest’ultimi furono contemporanei del sapiens e abitarono gli stessi posti in qualche periodo, certamente intorno a 150mila anni fa in Israele e dintorni.

– Il ramo dell’Homo erectus derivò dal ramo dell’ ergaster nel range 1.5 – 1.7 MAF (intorno al tempo della diffusione verso l’Europa anche dell’ergaster antico). L’areale dell’erectus poco dopo diffuse verso il lontano Oriente per poi estinguersi qui circa 100mila anni fa, non prima di aver generato, in Idonesia, un ramo particolare, l’Homo floresiensis, forse vicino ad un sapiens nano e microcefalo, costruttore di utensili simili a quelli evoluti dei nostri antenati della stessa epoca. Il floresiensis visse isolato nell’isola di Flores (Indonesia) da circa 90mila a 15mila anni fa.

– Sembrerebbe così che potessero esistere almeno tre possibilità ipotetiche alternative (?) per l’apparire del sapiens: l’una vede il sapiens come figlio africano diretto di ergaster evoluto in Africa o dell’heidelbergensis a partire da un ramo di radice circa 0.6 MAF sempre in area africana; l’altra vede il sapiens sorgere in Europa al termine della linea evolutiva degli ominidi ergaster antichi europei (H. antecessor) a partire da 1,2 MAF attraverso popolazioni intermedie (MODO 1) e l’ heidelbergensis dopo la comparsa del Neanderthal; la terza possibilità è un sapiens proveniente da un ramo dell’erectus nel lontano Oriente. Ma queste ipotesi non sono escluse dalle ricerche sul DNA che vedono il sapiens emergere solo in Africa fra 200mila e 100mila anni fa? Multiregionalismo falsificato?

Continua la revisione

Dal ceppo del famoso Hominide femmina Lucy, nella lontana Africa, a partire da almeno 2.5 MAF, seguì, fra le altre, una particolare tendenza verso la ‘costruzione’ del genere Homo, capace di cultura , l’Homo abilis. Furono piccoli esseri con la scintilla dell’intelligenza nello sguardo, che si muovevano eretti e attenti presso laghi e praterie, fermandosi lungo i greti dei fiumi a raccogliere ciottoli di selce con i quali fabbricare choppers (ciottoli scheggiati da una parte) e chopping-tools (da ambedue le parti) o ad organizzare accampamenti base per la caccia rispondendo ad un cervello più sviluppato di quello del ceppo di provenienza (forse l’Australopithecus afarense). Fu una cultura povera ed i choppers erano controllati probabilmente dalla forma del pezzo di pietra grezza iniziale piuttosto che da una sagoma mentale. Restarono in Africa e la colonizzarono almeno fino a 1.6 MAF. Oggi proprio nella Formazione di Bibbona [1], in eteropia, dalla parte della costa, dove si formarono depositi fluviali, è stata ritrovata una Pebble Culture con i suoi choppers e chopping-tools senza però presenza di fossili umani antichi, almeno secondo le nostre informazioni. Forse allora da un ramo più antico di H. ergaster, in Africa da circa 2 MAF fino a circa 200mila anni fa, dalla zona vicina alla divergenza con l’erectus, un gruppo di ergaster diffuse appunto verso l’Europa intorno a 1.5 MAF (antecessor). All’epoca della separazione l’ergaster possedeva ancora la Cultura su ciottolo, ma continuò ad evolvere e colonizzare l’Africa progredendo culturalmente fino a ‘partorire’ (una delle ipotesi) forse un sapiens nella sua forma primigenia in Africa Orientale intorno a 200mila anni fa. Approfittò magari dell’abbassamento del livello del mare della glaciazione Gunz (età della glaciazione) attraverso anguste strisce di terra e facili guadi ad Occidente ( o più probabilmente passando da Oriente?), fino a raggiungere anche Bibbona ed i Monti Livornesi. In effetti tracce di questa Cultura Oldowaiana si ritrovano in Europa, in un percorso segnato dal tempo, a partire dalla Spagna (1.2 MAF), alla Francia, Nizza e Massiccio Centrale (circa 1 MAF), forse in Italia centrale (730ka) e forse anche in Italia più a sud a Ceprano (430ka), attraverso la Germania (Karlic) fino a Praga. In Italia sarebbero giunti appunto circa 0.73 MAF in particolare sulla costa a Bibbona e quindi associati alla Formazione di Bibbona (1.2-0.781 MAF). Anche un’altra specie più evoluta del genere Homo (l’Homo erectus a cultura Aculeana) si staccò in Africa, da un ‘cespuglio’ di ergaster, a partire da 1.5 MAF; certamente migrò verso il lontano Oriente, in alcuni casi anche passando prima verso nord (forse da aree ad est) fino in Georgia e zona del Caucaso (H. georgicus), piegando poi verso il lontano oriente. La Cultura dell’erectus detta Acheuleano, aveva superato in Africa lo del ciottolo rozzamente scolpito e era rappresentata da un magico oggetto simbolico di selce a forma di mandorla, grosso come un pugno, ascia a mano (senza manico) a punta con margini taglienti con l’altro estremo più arrotondato per la presa, descritto come un bifacciale simmetrico, l’Amigdala (se uniamo gli indici fra loro e i pollici orizzontalmente e premiamo, otteniamo la sezione longitudinale dell’amigdala). Alcuni non vedendo un uso efficace di questo strumento in relazione alle sue dimensioni (circa un decimetro di lunghezza), pensarono ad un oggetto magico e sacro collegabile all’intimo femminile. Allora, se l’erectus si fosse diffuso anche in Europa, la Cultura Oldowaiana europea potrebbe essere attribuita (anche) a lui? Ci fu allora uno sfasamento culturale dall’Acheuleano all’ Oldowaiano? come da qualche studioso suggerito. Ma sembra plausibile che una Cultura possa regredire così facilmente, magari per mancanza di materiali grezzi opportuni o diversi? Le difficoltà non servono forse ad acuire l’ingegno, se dato? A meno che non si applichi l’ingegno a materiali diversi ugualmente efficaci per la sopravvivenza, ma difficilmente fossilizzabili, come, per esempio, il bambù od altro incontrati dall’erectus nel Lontano Oriente, dove, sembra, non furono trovate amigdale. Queste diffusioni dall’Africa non implicarono però un impoverimento evolutivo di questo continente (infatti solo in esso sembra sia apparso l’uomo nuovo!). Se l’ergaster rimase il centro principale dell’evoluzione umana in Africa fino all’emerge dello stesso uomo moderno, questo potrebbe significare che a lasciare l’Africa furono le popolazioni evolutivamente più povere? Il genoma dell’erectus, staccatosi dal ramo dell’ergaster precocemente (1.5 MAF), era potenzialmente più predisposto a generare sapiens (Homo di Flores, un sapiens nano) dell’hedelbergensis separatosi dall’ergaster quasi un milione di anni dopo (generò infatti solo il Neandhertal)? La molla del ‘migrare’ non è forse, insieme ad altro, la curiosità? La curiosità quindi nell’evoluzione non paga? Il sapiens è sorto solo in Africa? Perchè in Europa si rinvengono crani umani che hanno una natura duplice, con una architettura che guarda all’antico, mentre i caratteri fini guardano ai contemporanei europei come H. heidelbergensis? quasi che l’H.heidelbergensis sia sorto dall’ergaster in Italia (o anche in Italia), da popolazioni con crani come l’H. cepranensis ARGIL. Perchè allora l’uomo nuovo non è sorto in Italia?

Sempre nella zona di Bibbona, topograficamente al di sopra del sito Oldowaiano, in età almeno di 120mila anni, sempre in sabbie di costa, in eteropia con la parte alta dei Conglomerati di Bolgheri (), si trova un sito a Cultura Acheuleana. E’ proprio sulle sponde di fiumi antichi del Riss nella bassa Val di Cecina che sono state rinvenute le amigdale, gli oggetti quasi sacri dell’erectus o dell’ergaster evoluto ovvero forse ultima coda dell’H. heidelbergesis, la forma di radice africana (600mila anni fa era in Etiopia) che circa 200mila anni fa, prima di estinguersi, dette i natali al Neandhertal (in Europa ed in Africa?)

(dott. Piero Pistoia)

4-NOTE-FOTOSINTESI CLOROFILLIANA

NOTE

I disegni sotto riportati, replicati più volte su Internet in svariati altri interventi e appunti di diversi autori di altri blogs, sono stati ritrasferiti rivisitati anche su questo.

CENNI ALLA FOTOSINTESI CLOROFILLIANA (Letture e pensieri così come vengono, ripresi a spirale)

PREMESSA

La fotosintesi clorofilliana è un meccanismo che fornisce nutrimento ed energia e quindi è condizione necessaria e spesso sufficiente per mantenere in vita la pianta e la vita sulla terra. Infatti dalla sua efficienza dipendono la garanzia della riproduzione di tutti i viventi e la continuità stessa della vita.

Le piante verdi sono organismi autotrofi, cioè riescono, a partire da composti inorganici (sali minerali del terreno, acqua e anidride carbonica), a formare composti organici che servono a mantenere e costruire il loro corpo (organicazione): da H2O+CO2 si arriva ad un composto del gruppo degli zuccheri che può condensarsi in amido e insieme a sostanze nitriche e ammoniacali darà composti azotati. Gli animali in genere sono invece eterotrofi, cioè riescono solo a organizzare il materiale costruito dagli autotrofi. Il processo di organicazione del materiale inorganico è permesso da un insieme complesso di reazioni chimiche non ancora completamente capite che si chiama fotosintesi clorofilliana. La fotosintesi perciò è il processo mediante il quale la materia organica, immersa in una atmosfera di ossigeno, si oppone alla sua completa e veloce “combustione” in CO2 + H2O. La respirazione stessa è una specie di “combustione controllata” che l’organismo è riuscito a ‘progettare’ durante la sua evoluzione e utilizzare per i suoi fini.

Ma per passare da materiali semplici (inorganici) a quelli complessi, che si configurano come “mattoni” per costruire la materia vivente, c’è bisogno di un grosso quantitativo di energia, ma anche un “meccanismo strutturato” progettato e costruito dall’evoluzione per utilizzarla in un processo mirato a tale lavoro. La pianta cattura tale energia da una sorgente storicamente inesauribile: il sole. La cosa sembra semplice, ma in effetti, in generale, scaldare più molecole semplici (quelle inorganiche) al sole non provoca nessuna reazione utile, come nessun oggetto si muove se ci limitiamo a trasformare acqua in vapore (vedere il 2° principio della termodinamica)!

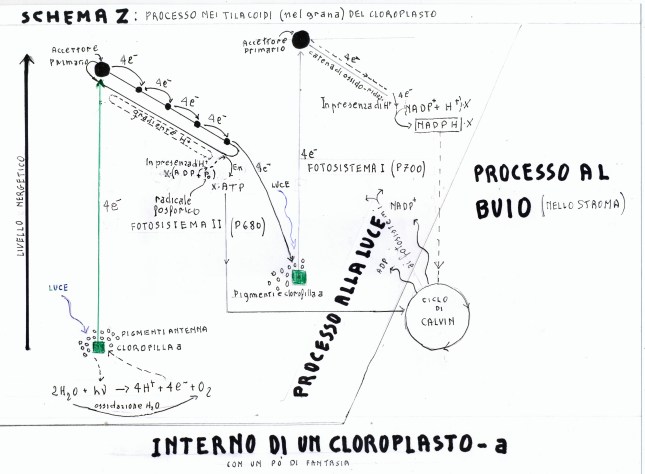

RACCONTO A LIVELLO ZERO

E’ necessario così prima capire che cosa si intende per ossidazione e riduzione, perché la maggior parte dei passaggi nel processo fotosintetico sono reazioni di ossido-riduzione. E’ inoltre richiesta una minima conoscenza della chimica elementare. Una molecola chimica si ossida quando cede elettroni e si riduce quando ne acquista; nelle reazioni dove entrano in gioco ossigeno e idrogeno, una combinazione con ossigeno significa ossidazione e con idrogeno riduzione (infatti, per es., se l’elemento Ca (neutro, ossidazione 0) si combina con l’elemento ossigeno (neutro) a dare CaO, cioè Ca(2+) O(2-), si vede che si è ossidato cedendo due elettroni negativi; si dice anche che è aumentato il suo numero di ossidazione da 0 a 2, mentre O si riduce. L’ossidazione è una specie di piccola combustione e libera energia nei dintorni; la riduzione invece ne assorbe. Una molecola che si riduce acquista dentro di sé energia chimica. Così l’energia solare può essere catturata da molecole che si riducono e trasportata da una molecola all’altra in una catena di ossido-riduzioni con salti energetici in discesa (vedere schemi dei due sistemi fotosintetici). Cerchiamo di capire. la luce spacca una molecola di acqua (fase luminosa della fotosintesi) liberando ossigeno molecolare ( da H2O – i due idrogeno del composto hanno numero di ossidazione 2+ – si formano 2H+ (cioè due protoni, atomi di idrogeno senza elettroni); mentre l’ossigeno passa da -2 a zero 1/2*O2). Durante la fase al buio della fotosintesi avrò disponibili varie molecole di ATP e NADPH ad alta energia chimica costruite durante la fase luminosa (vedere schema Z) che saranno capaci di operare le reazioni chimiche di riduzione ad alto assorbimento energetico richiesto dal passaggio dall’inorganico all’organico. Rimane comunque il problema sul modo in cui la luce del sole riesca a spaccare la molecola d’acqua; sembra che l’energia luminosa ecciti una molecola di clorofilla, contenuta nelle parti verdi della pianta (fase luminosa), portandola ad uno stato altamente energetico (salto di elettroni su livelli elevati) così da determinare la scissione dell’acqua, bombardata da quanti di ‘luce’ opportuni, quando ritorna al suo stato iniziale, con il conseguente passaggio dell’energia anche ai trasportatori di elettroni liberati fino alla zona dove sarà utilizzato per i processi di organicazione del carbonio (ciclo di Calvin). Così all’interno di cellule opportune delle parti verdi della pianta (cloroplasti), che contengono vari tipi di clorofille, avvengono complicate reazioni di ossido-riduzione in due sistemi fotosintetici, vedere dopo foto (fase luminosa), che conducono alla formazione di molecole di trasporto ricche di energia nei loro legami chimici (ATP e NADPH, vedere dopo) che, nella fase oscura (ciclo di CALVIN), serviranno a costruire le molecole carboniose (organicazione della CO2) utili a produrre poi protidi, lipidi…

Nella scissione dell’acqua si libera ossigeno nell’atmosfera. Un riassunto sulle tappe principali del processo fotosintetico è dato nel così detto “SCHEMA H” di fig. 11 della T. sinottica e ‘SCHEMA ZETA’ che cercheremo di illustrare meglio. Vedremo meglio anche introducendo la distinzione fra la fotosintesi delle piante di tipo C3 e di tipo C4 ed accennando ai vari passaggi ipotetici che, per ora, non sono completamente conosciuti.

Come già accennato le piante verdi sono autotrofe, cioè riescono a produrre molecole organiche complesse (con alta energia nei loro legami) a partire da semplici composti inorganici ed acqua (poveri di energia) con in più energia luminosa che bilanci almeno la differenza.

Per far questo utilizzano un meccanismo chimico a struttura complessa ancora non completamente compreso, la fotosintesi clorofilliana, che avviene all’interno delle cellule delle foglie verdi dette cloroplasti o plastidi entro cui è contenuta la clorofilla nelle sue diverse forme. Attraverso complicate reazioni durante la fase luminosa, in particolare di ossido-riduzione nel trasferimento energetico, che avvengono in due fotosistemi collegati, vengono prodotte molecole energetiche come l’ATP e NADPH, che serviranno poi alle altre cellule del cloroplasto per sintetizzare nel Ciclo di Calvin, le molecole carboniose, zuccheri, cioè i mattoni di partenza per produrre proteine, lipidi, ….

Il processo globale sembra essere sintetizzato con la reazione:

nCO2 + nH2O + nNhn (?) → (CH2O)n + nO2

Energia per ogni mole = Nhn

N=numero di Avogadro=6*10^23 molecole/mole; h=costante di Plank=6.62*10^(-34) joule*sec; ν=frequenza del fotone

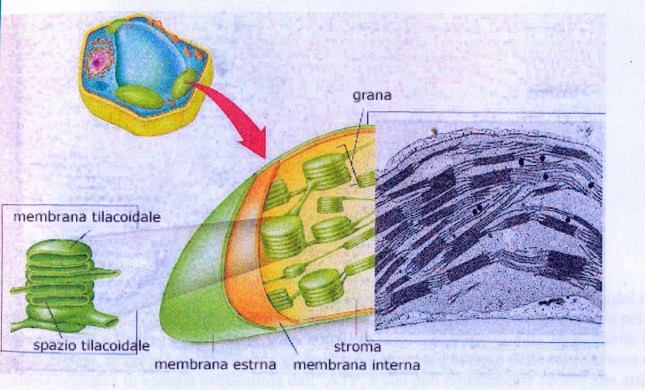

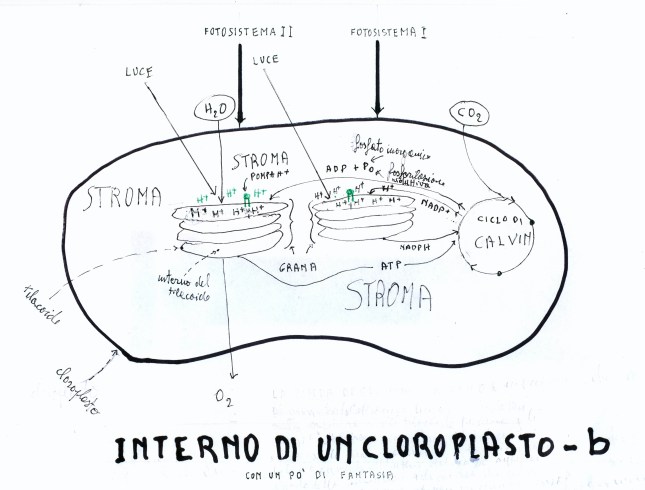

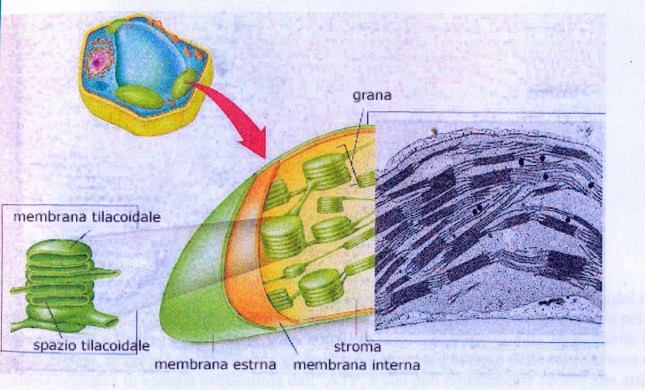

IL CLOROPLATO

Questo processo avviene appunto nei cloroplasti o plastidi (simili a mitocondri, gli organuli_fabbrica dell’energia cellulare). Un cloroplasto è un organello all’interno delle cellule delle foglie o delle parti verdi, circondate da una doppia membrana che racchiude un mezzo semifluido, lo stroma. Nello stroma vi è un sistema di membrane ripiegate a formare dischetti, detti tilacoidi (vedi fig. IL CLOROPLASTO ). Un gruppo di tilacoidi sovrapposti formano delle pile in cilindretti detti grana (plurale di granum). Nello spessore della membrana dei tilacoidi ci sono tutti i pigmenti: dalle clorofille nelle loro diverse forme (verdi), ai carotenoidi (gialli rossi porpora) …. Nella parte della membrana dei tilacoidi che contiene anche i trasportatori di elettroni, gruppi di pigmenti formano, insieme ad una sequenza di molecole (catena fotosintetica), i due SISTEMI FOTOSINTETICI II e I.

RACCONTO DI PRIMO LIVELLO

Il racconto è in via di costruzione e correzione.

Questo primo livello precisa brevemente i diversi stadi della fotosintesi clorofilliana. Cerca di esplicitare alcuni passaggi delle reazioni, a partire dalla foto-scissione dell’acqua, che avvengono nei due fotosistemi durante la fase luminosa (vedere schema Z) e precisa alcuni processi del ciclo di CALVIN. Nelle ore diurne sulla superficie dei tilacoidi (vedere schema relativo) si attivano molti pigmenti, costituiti da clorofilla-a e l’insieme dei pigmenti-antenna in particolare la clorofilla b. La clorofilla-a assorbe direttamente dalla luce del sole una data lunghezza d’onda che le compete, e dai pigmenti-antenna, dopo che sono stati attivati dall’energia solare, una lunghezza d’onda analoga. Essa si ossida liberando 2 elettroni che passano ad un accettore primario di elettroni che riducendosi acquisisce un alto livello energetico di partenza per il processo. Sotto questi due impulsi energetici, la clorofilla-a riuscirà a ‘rompere’ anche una molecola d’acqua in 1 atomo di ossigeno, in due ioni H+(protoni) e due elettroni che ricaricheranno di energia al momento giusto la molecola di clorofilla-a. Si formerà anche una molecola di ossigeno che andrà a contribuire al 21% di ossigeno nell’aria. I due protoni dell’acqua completeranno infine la riduzione dell’ ADP in ATP e dell’NADP in NADPH, che si troveranno carichi di energia alla fine del processo. Nel contempo dall’accettore primario ad alta energia si distacca una catena di ossido-riduzione con il passaggio in una successione dei due elettroni ricevuti ad una serie di molecole, ognuna delle quali si ossida (una specie di ‘sbruciacchiamento’) riducendo la successiva che a sua volta si carica di energia, ma ad un livello ancora inferiore e così via, mentre la maggior parte dell’energia liberata ad ogni passaggio va a ridurre trasversalmente una mole di ATP che immagazzina energia per gli altri scopi della pianta. (da rivedere)

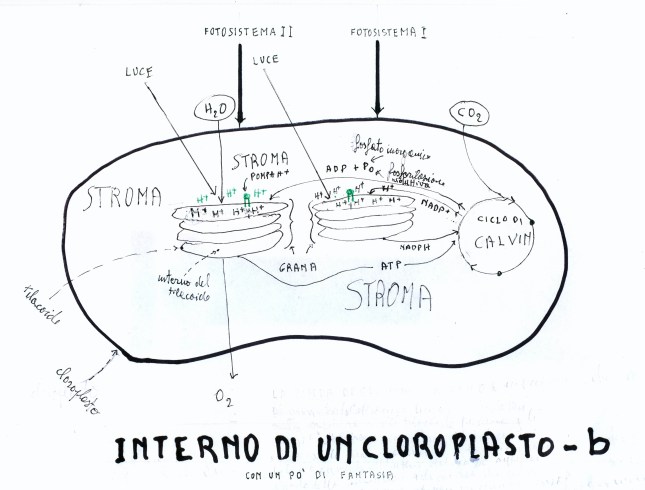

UNO SGUARDO FUNZIONALE ALL’INTERNO DI UN CLOROPLASTO

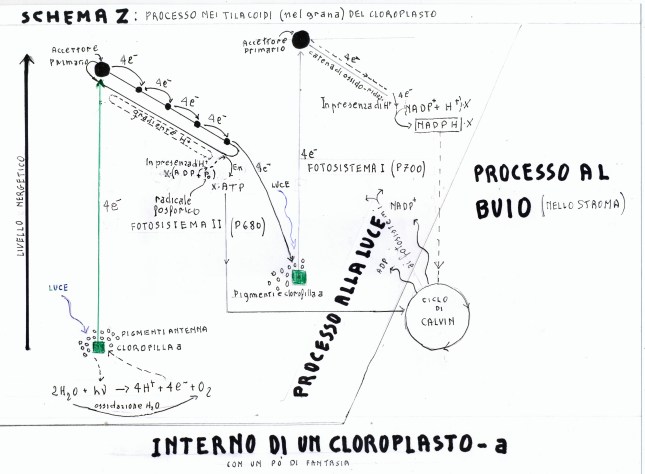

I DUE SISTEMI FOTOSINTETICI: SCHEMA ZETA

LA FOTOLISI DELL’ACQUA, LA ‘POMPA PROTONICA’ E il ‘MECCANISMO CHEMIOSMOTICO’ DEGLI IONI IDROGENO (Ipotesi chemiosmotica di Mitchell).

Seguire lo scritto sui disegni molto approssimati, ‘INTERNO DI UN CLOROPLATO a e b, sopra riportati

L’energia luminosa assorbita direttamente e, di riflesso indirettamente convogliata ad imbuto, dalla clorofilla-a (diventata una specie di trappola per l’energia), tramite i pigmenti antenna, provoca salti di alcuni suoi elettroni (per es. 4 se la fotolisi interessa 2 molecole di acqua ossidate a O2) a livelli energetici superiori e subito dopo si ossida trasferendo tali elettroni eccitati ad un accettore primario che si riduce caricandosi a sua volta di energia. Definiamo risonanza induttiva un percorso per cui una molecola eccitata può trasferire la sua energia ad un’altra molecola adiacente che resta anch’essa eccitata. Così, anche se la clorofilla-a del fotosistema II non può assorbire direttamente quelle frequenze assorbite invece dai pigmenti antenna, quest’ultimi tramite fluorescenza e risonanza induttiva riemettono quanti luce con una lunghezza d’onda conforme alla clorofilla-a (680 nanometri). Il fotosistema II è siglato appunto P680. Nel contempo 4 fotoni sprigionati dal ‘cuore’, centro di reazione del P680 (?), colpiscono 2 molecole di acqua ossidandole a O2 (che si perderanno in atmosfera) con liberazione, nell’intorno, di 4 protoni (ioni H+), man mano trascinati nel lume del tilacoide, e 4 elettroni che andranno a ricoprire i 4 vuoti interni aperti nella clorofilla-a, che aveva perso 4 elettroni.

La corrente di elettroni lungo i trasportatori sulla membrana del tilacoide ‘pompa’ gli ioni H+, liberati dai quanti di luce nell’ossidazione dell’acqua, nello spazio interno (lume) del tilacoide. Così la densità degli H+ aumenta ed il PH diminuisce nel lume del tilacoide rendendo più acido l’ambiente rispetto allo STROMA del cloroplasto. Gli H+, spinti poi dal gradiente elettrochimico, possono uscire nello stroma fino ad incontrare, uscendo attraverso un canale proteico dove è attivo un enzima per la sintesi di ATP e NADPH, le molecole da ridurre ADP e NADP+ di ritorno dal Ciclo di Calvin, venendo a favorire questa sintesi.

DA CONTINUARE

IL RACCONTO DI SECONDO LIVELLO: la ‘piccola’ evoluzione fotosintetica

IL RACCONTO DI SECONDO LIVELLO: la ‘piccola’ evoluzione fotosintetica

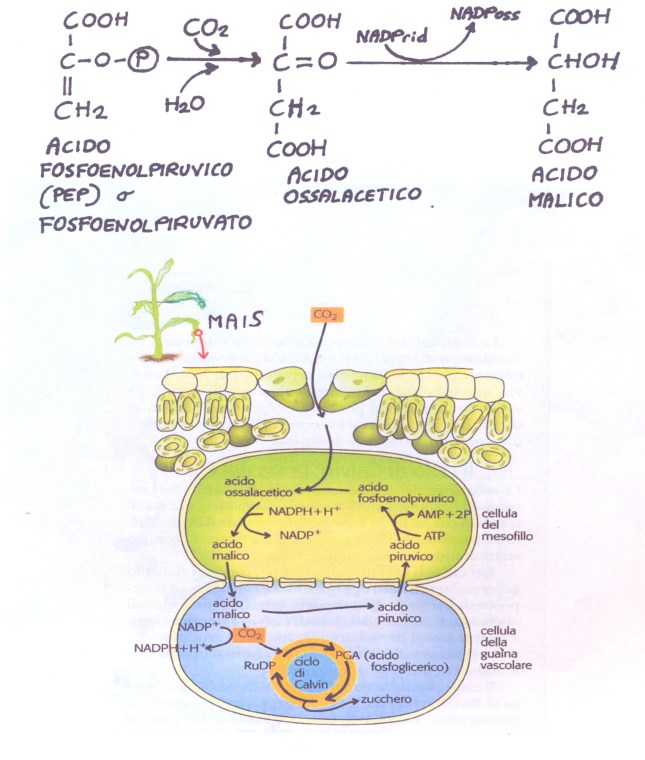

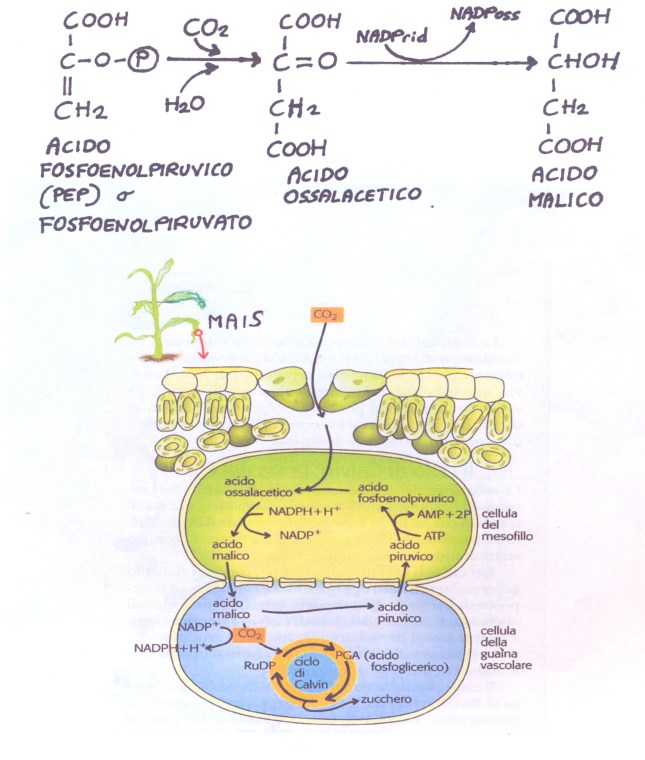

Durante l’evoluzione delle piante, ad un certo punto del loro albero filetico, la vita che evolve riesce ad attivare un primo processo fotosintetico a clorofilla detto C3. La pianta C3 è una fotosintetica di primo ‘tentativo’, nel senso che, forse per una leggera modifica ambientale, si troverà, almeno in alcune zone, in difficoltà. L’evoluzione del processo fotosintetico può essere considerata nell’ambito delle ‘piccole’ evoluzioni o a corto raggio, rispetto alla generale evoluzione delle piante, anche se ‘sommatorie integrate’ di eventi evolutivi a corta raggio ‘indirizzeranno’ la grande evoluzione. La pianta C3 è una fotosintetica che fornisce come primo prodotto organicato un composto a tre atomi di carbonio (triosio). In effetti questa pianta, in funzione della disponibilità di CO2, che diminuisce aumentando la temperatura ambientale, insieme al loro rapporto CO2/O2, può incepparsi in corrispondenza del funzionamento di un enzima (il rubisco, RuBP), che invece di legarsi alla CO2 , si lega a O2 bloccando il ciclo di Calvin al buio e quindi non ‘organica’ la CO2, entra in foto-respirazione invece di foto-sintetizzare, ‘bruciando’ molecole energetiche invece di costruirle. In effetti l’enzima Rubisco (RuBP) è poco efficiente nel discriminare fra CO2 e O2 , per cui, quando la temperatura dell’aria raggiunge per es., 27-30 °C a salire, la CO2 in atmosfera diventa sempre più rarefatta, il rapporto CO2/O2 diminuisce, il Rubisco tende sempre più a legarsi con l’O2 e sempre meno con la CO2. E’ allora che l’enzima entra in difficoltà nell’iniziare l’ “organicazione” (cioè trasformare la molecola inorganica CO2 in una molecola organica più complessa ricca di energia) – es., emblematico: per ottenere un esoso come il glucosio alla fine del ciclo – si rafforza la fase di foto-respirazione, tendendo ad esaurire la riserva di molecole energetiche, invece di costruirle, bloccando o indebolendo, nel migliore dei casi, il ciclo di Calvin. Se la situazione non cambiasse, la pianta soffrirebbe fino a morire. L’evoluzione, a temperatura ambientale elevata (clima caldo-arido), tenderà allora ad intervenire cercando di rafforzare la concentrazione di CO2 dove sta agendo l’enzima, onde impedire il blocco del ciclo di Calvin. Appariranno così le prime ‘piante intermedie C3-C4’ e poi le C4, inventando un meccanismo che permetta durante la fase oscura, a stomi aperti, la raccolta di molecole CO2 (attraverso l’aggancio con un composto chimico) anche nelle cellule parenchimatiche del mesofillo, trasferendole alle cellule dei cloroplasti, per poi convogliarle alle cellule fotosintetiche, per rendere la CO2 disponibile all’enzima Rubisco (dopo una una reazione di idrolisi sul composto precedentemente accennato) e continuare il percorso C3 fino alla ‘organicazione’ della CO2. Le piante C4 sono una correzione evolutiva (ancora in trasformazione?) delle piante C3. E’ nelle piante CAM (di clima caldo e secco) che il processo si perfeziona in un meccanismo che risparmia acqua, diviso in due tempi; nel primo, al buio a stomi aperti (bassa traspirazione), si raccoglie e si accumula la CO2 nei vacuoli delle cellule dei cloroplasti; nel secondo tempo, alla luce ma a stomi chiusi (risparmio acqua), continua il vecchio processo C3, col l’enzima Rubisco che aggancia le molecole, questa volta, di CO2 dai vacuoli, ora in concentrazione giusta e procede al buio col ciclo di Calvin. Insomma, la pianta C3, perfettamente funzionante quando la composizione atmosferica era quella di una volta, ora con il mutare delle temperature medie e delle concentrazioni di CO2 e O2 nell’aria e con la diminuzione del loro rapporto dovuti all’inquinamento, si trova fortemente disadattata per cui si è riattivato il processo evolutivo.

DA INTEGRARE E CONTINUARE associando i grafici.